【多GPU炼丹-绝对有用】PyTorch多GPU并行训练:深度解析与实战代码指南

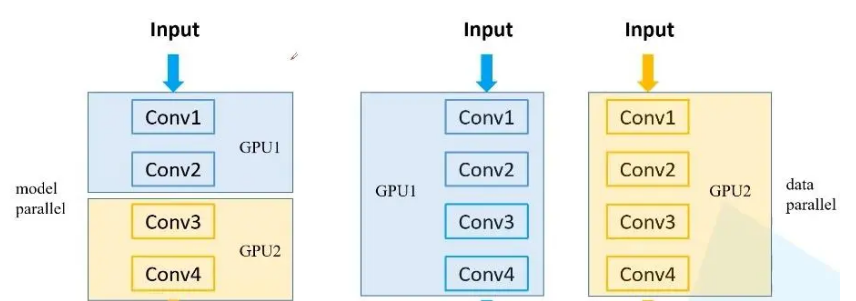

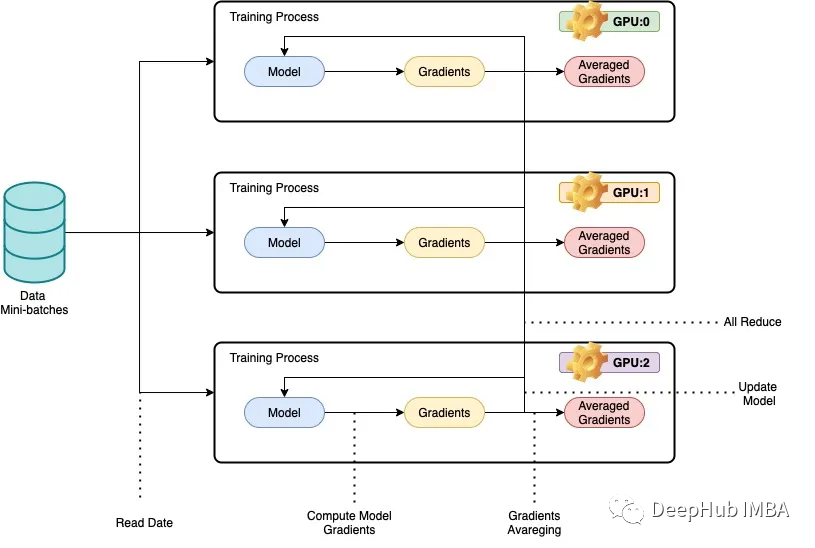

a. 数据拆分,模型不拆分 b. 数据不拆分,模型拆分 c. 数据拆分,模型拆分 在深度学习的炼丹之路上,多GPU的使用如同助燃剂,能够极大地加速模型的训练和测试。根据不同的GPU数量和内存配置,我们可以选择多种策略来充分利用这些资源。今天,我们将围绕“多GPU炼丹”这一主题,深度解析PyTorch多GPU并行训练的技巧,并为大家带来实战代码指南。在这个过程中,我们将不断探讨和展示如何...

PyTorch 并行训练 DistributedDataParallel完整代码示例

训练时间长:训练过程可能需要数周甚至数月才能完成,具体取决于模型的复杂性和数据集的大小。内存限制:大型 DNN 可能需要大量内存来存储训练期间的所有模型参数、梯度和中间激活。 这可能会导致内存不足错误并限制可在单台机器上训练的模型的大小。为了应对这些挑战,已经开发了各种技术来扩大具有大型数据集的大型 DNN 的训练,包括模型并行性、数据并行性和混合并行性,以及硬件、软件和算法的优化。在本文中我们....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

pytorch您可能感兴趣

- pytorch模型

- pytorch实战

- pytorch安装

- pytorch环境

- pytorch策略

- pytorch内存

- pytorch资源

- pytorch架构

- pytorch构建

- pytorch deepseek-v2

- pytorch神经网络

- pytorch教程

- pytorch训练

- pytorch学习

- pytorch数据集

- pytorch tensorflow

- pytorch官方教程

- pytorch卷积

- pytorch gpu

- pytorch卷积神经网络

- pytorch数据

- pytorch源码

- pytorch分类

- pytorch框架

- pytorch案例

- pytorch学习笔记

- pytorch版本

- pytorch张量

- pytorch python

- pytorch入门