【传知代码】从零开始搭建图像去雾神经网络-论文复现

本文涉及的源码可从从零开始搭建图像去雾神经网络该文章下方附件获取 本文复现了一种简单而有效的基于集成学习的双分支非均匀去雾神经网络。该方法使用一个双分支神经网络分别处理上述问题,然后通过一个可学习的融合尾映射它们的不同特征。论文地址:https://arxiv.org/pdf/2104.08902.pdf 概述 图像去雾神经网络的应用范围相当广泛:...

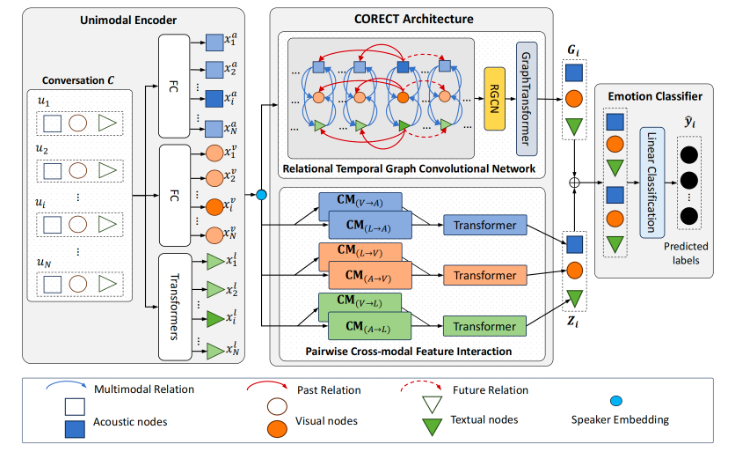

【传知代码】图神经网络长对话理解-论文复现

本文涉及的源码可从图神经网络长对话理解该文章下方附件获取 论文:Conversation Understanding using Relational Temporal Graph Neural Networks with Auxiliary Cross-Modality Interaction原文链接ACL2023 概述 情感识别在促进人类对话深度理解中占据举足轻重的地位...

经典神经网络论文超详细解读(八)——ResNeXt学习笔记(翻译+精读+代码复现)

前言今天我们一起来学习何恺明大神的又一经典之作: ResNeXt(《Aggregated Residual Transformations for Deep Neural Networks》)。这个网络可以被解释为 VGG、ResNet 和 Inception 的结合体,它通过重复多个block(如在 VGG 中)块组成,每个block块聚合了多种转换(如 Inception),同时考虑到跨层连....

经典神经网络论文超详细解读(七)——SENet(注意力机制)学习笔记(翻译+精读+代码复现)

前言上一期文章中我们介绍了DenseNet,该网络核心在于每一个密集块中的每一层的输入都包含了前面的所有层,这些层通过在通道维度上进行拼接,从而一同作为下一层的输入。这在一定程度上缓解了梯度消失的问题,也由此可以构建更加深层次的神经网络。指路→经典神经网络论文超详细解读(六)——DenseNet学习笔记(翻译+精读+代码复现)今天我们继续来学习一种新的网络SENet(《Squeeze-and-E....

经典神经网络论文超详细解读(六)——DenseNet学习笔记(翻译+精读+代码复现)

前言上一篇我们介绍了ResNet:经典神经网络论文超详细解读(五)——ResNet(残差网络)学习笔记(翻译+精读+代码复现)ResNet通过短路连接,可以训练出更深的CNN模型,从而实现更高的准确度。今天我们要介绍的是 DenseNet(《Densely connected convolutional networks》) 模型,它的基本思路与ResNet一致,但是在参数和计算成本更少的情形下....

经典神经网络论文超详细解读(五)——ResNet(残差网络)学习笔记(翻译+精读+代码复现)

前言《Deep Residual Learning for Image Recognition》这篇论文是何恺明等大佬写的,在深度学习领域相当经典,在2016CVPR获得best paper。今天就让我们一起来学习一下吧!论文原文:https://arxiv.org/abs/1512.03385前情回顾:经典神经网络论文超详细解读(一)——AlexNet学习笔记(翻译+精读)经典神经网络论文超详....

经典神经网络论文超详细解读(四)——InceptionV2-V3学习笔记(翻译+精读+代码复现)

前言上一篇我们介绍了Inception的原始版本和V1版本:经典神经网络论文超详细解读(三)——GoogLeNet学习笔记(翻译+精读+代码复现) 这个结构在当时获得了第一名,备受关注。但InceptionV1是比较复杂的,于是作者潜力研究之后又推出了改进后的版本Inception V2-V3(《Rethinking the Inception Architecture for Computer....

经典神经网络论文超详细解读(三)——GoogLeNet InceptionV1学习笔记(翻译+精读+代码复现)

前言 在上一期中介绍了VGG,VGG在2014年ImageNet 中获得了定位任务第1名和分类任务第2名的好成绩,而今天要介绍的就是同年分类任务的第一名——GoogLeNet 。 作为2014年ImageNet比赛冠军,GoogLeNet 比VGG更深的网络,比AlexNet少了12倍参数,但更加精准....

特斯拉AI总监:我复现了LeCun 33年前的神经网络,发现和现在区别不大

最近,特斯拉 AI 高级总监 Andrej Karpathy 做了一件很有趣的事情,他把 Yann LeCun 等人 1989 年的一篇论文复现了一遍。一是为了好玩,二是为了看看这 33 年间,深度学习领域到底发生了哪些有趣的变化,当年的 LeCun 到底被什么卡了脖子。此外,他还展望了一下 2055 年的人将如何看待今天的深度学习研究。1989 年,Yann Lecun 等人发表了一篇名为「B....

我用 PyTorch 复现了 LeNet-5 神经网络(自定义数据集篇)!

正文开始!三、用 LeNet-5 训练自己的数据下面使用 LeNet-5 网络来训练本地的数据并进行测试。数据集是本地的 LED 数字 0-9,尺寸为 28x28 单通道,跟 MNIST 数据集类似。训练集 0-9 各 95 张,测试集 0~9 各 40 张。图片样例如图所示:3.1 数据预处理制作图片数据的索引对于训练集和测试集,要分别制作对应的图片数据索引,即 train.txt 和 tes....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。