集成学习实现方法

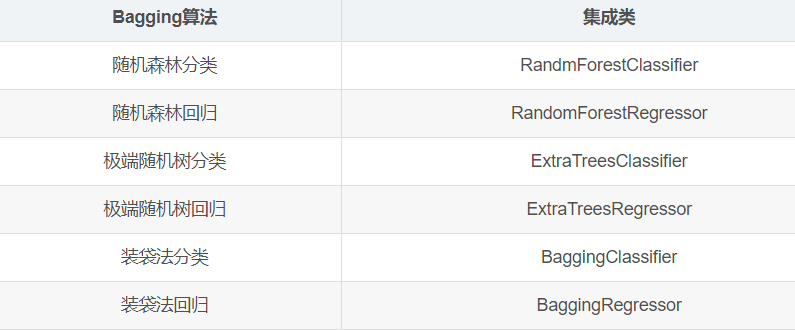

根据个体学习器生成方式的不同,目前集成学习的实现方式主要分为两种,一种是 Bagging 算法为代表的并行式集成学习方法,其中最典型的应用当数“随机森林算法”;另一种是以 Boosting 算法为代表的串行式集成学习方法,其中应用频率较高的有两个 AdaBoost 算法和 XGBoost 算法。除上述两种主要的方法外ÿ...

Lesson 9.1 集成学习的三大关键领域、Bagging 方法的基本思想和 RandomForestRegressor 的实现

文章目录一、 集成学习的三大关键领域二、Bagging 方法的基本思想三、RandomForestRegressor 的实现在开始学习之前,先导入我们需要的库,并查看库的版本。import numpy as np import pandas as pd import sklearn import matplotlib as mlp import seaborn as sns import re,....

《中国人工智能学会通讯》——9.11 集成学习的基本方法

9.11 集成学习的基本方法 集成学习能够把多个单一学习模型所获得的多个预测结果进行有机地组合,从而获得更加准确、稳定和强壮的最终结果。集成学习的原理来源于 PAC 学 习 模 型(Probably approximately correctlearning)。Kearns 和 Valiant 最早探讨了弱学习算法与强学习算法的等价性问题[3-4] ,即提出了是否可以将弱学习算法提升成强学习算法....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

集成学习相关内容

- 集成学习性能

- 学习集成swagger

- 学习集成

- 机器学习集成学习

- 模型集成学习

- 集成学习stacking

- 集成学习随机森林

- 集成学习梯度

- 集成学习机器学习

- 集成学习learning

- 集成学习分类

- 机器学习集成学习模型

- 分类集成学习

- 集成学习bagging boosting

- 机器学习集成学习boosting

- 集成学习boosting

- 集成学习原理

- 集成学习树

- 集成学习gradient

- 集成学习梯度树

- 集成学习决策树

- 集成学习gradient boosting

- scikit-learn集成学习

- 教程集成迁移学习

- 教程集成学习

- 集成迁移学习

- xgboost集成学习

- 集成学习模型

- 学习集成gitlab

- 集成学习task1