又改ResNet | 重新思考ResNet:采用高阶方案的改进堆叠策略(附论文下载)(二)

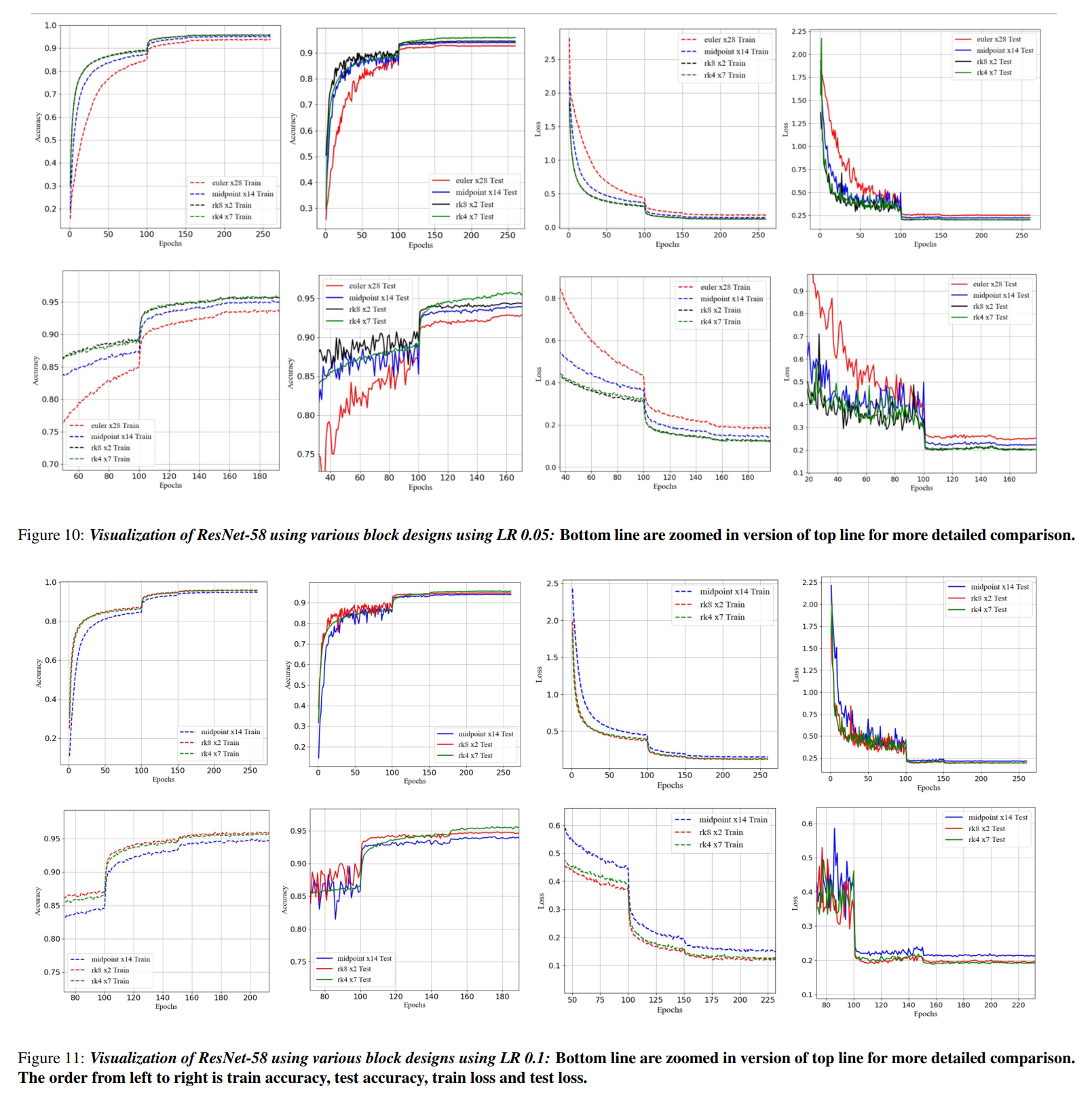

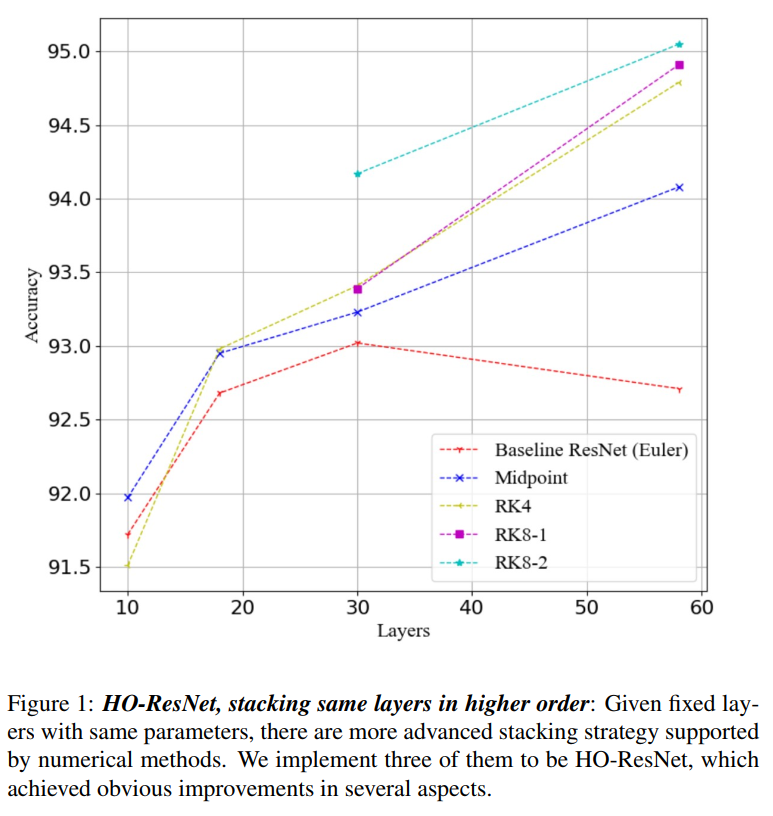

3 实验如图10所示,在相同的设置和参数下,采用高阶叠加方法,红线所代表的基线ResNet得到了明显的改善。作者注意到fixed RK8方法有改进的潜力。它在早期阶段高于RK-4。在Verner的设计中,还应保持一个比例因子h和误差来调整台阶侧。作者认为是固定步长导致RK-8退化到RK-4。由于收敛是有益的,作者相信在更深的模型中嵌套叠加可能有更好的性能。4 参考[1].Rethinking R....

又改ResNet | 重新思考ResNet:采用高阶方案的改进堆叠策略(附论文下载)(一)

1 简介本文提出了更高阶的ResNet变体:HO-ResNet,平均涨2+个点!并进行了大量实验验证到该方法可以使性能显著的提高的同时也有助于模型的收敛和鲁棒性。(居然连ResNet-RS都引用了,太卷了)文章总结到网络整体结构的设计缺乏一般性的指导。基于近年来一些研究人员观察到的DNN设计与数值微分方程之间的关系,本文对残差设计和高阶视角进行了公平的比较。图1 将相同的层按更高的顺序堆叠在扎实....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

ResNet您可能感兴趣

- ResNet模型

- ResNet图像

- ResNet分类

- ResNet networks

- ResNet resnet

- ResNet深度学习

- ResNet应用

- ResNet原理

- ResNet网络

- ResNet图像识别

- ResNet pytorch

- ResNet训练

- ResNet入门

- ResNet图像分类

- ResNet神经网络

- ResNet结构

- ResNet数据集

- ResNet mobilenet

- ResNet densenet

- ResNet部署

- ResNet复现

- ResNet任务

- ResNet优化

- ResNet算法

- ResNet vit

- ResNet参数

- ResNet块

- ResNet机器学习

- ResNet代码

- ResNet简介