Mixtral 8X7B MoE模型在阿里云PAI平台的微调部署实践

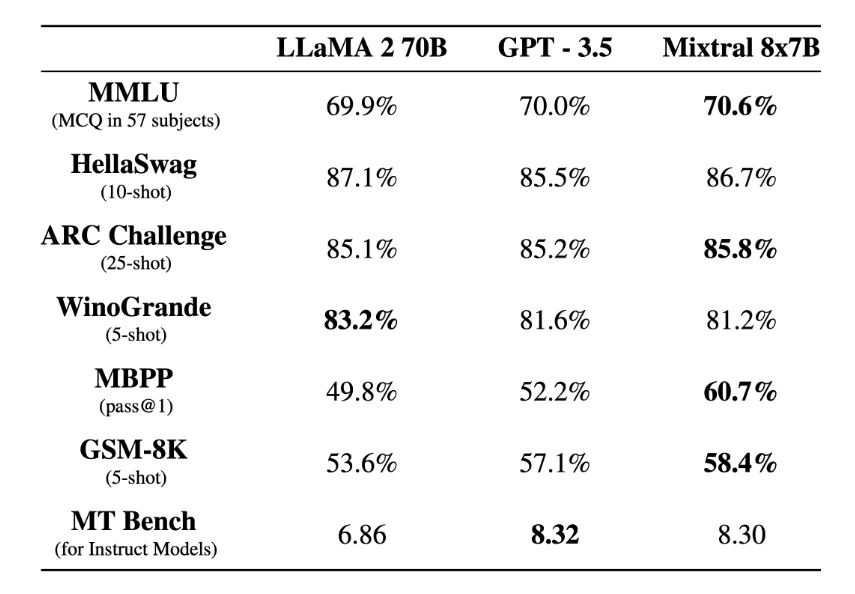

1.引言Mixtral 8x7B 是Mixtral AI最新发布的大语言模型,在许多基准测试上表现优于 GPT-3.5,是当前最为先进的开源大语言模型之一。阿里云人工智能平台PAI是面向开发者和企业的机器学习/深度学习平台,提供了对于 Mixtral 8x7B 模型的全面支持,开发者和企业用户可以基于 PAI-快速开始(PAI-QuickStart)轻松完成Mixtral 8x7B 模型的微调和....

通义千问Qwen-72B-Chat基于PAI的低代码微调部署实践

1.引言通义千问-72B(Qwen-72B)是阿里云研发的通义千问大模型系列的720亿参数规模模型。Qwen-72B的预训练数据类型多样、覆盖广泛,包括大量网络文本、专业书籍、代码等。Qwen-72B-Chat是在Qwen-72B的基础上,使用对齐机制打造的基于大语言模型的AI助手。阿里云人工智能平台PAI是面向开发者和企业的机器学习/深度学习平台,提供AI开发全链路服务。快速开始(PAI-Qu....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

机器学习平台 PAI您可能感兴趣

- 机器学习平台 PAI scikit-learn

- 机器学习平台 PAI python

- 机器学习平台 PAI代码

- 机器学习平台 PAI论文

- 机器学习平台 PAI数字识别

- 机器学习平台 PAI实战

- 机器学习平台 PAI numpy

- 机器学习平台 PAI降维

- 机器学习平台 PAI模型

- 机器学习平台 PAI构建

- 机器学习平台 PAIpai

- 机器学习平台 PAI算法

- 机器学习平台 PAIpython

- 机器学习平台 PAI数据

- 机器学习平台 PAI应用

- 机器学习平台 PAI训练

- 机器学习平台 PAI人工智能

- 机器学习平台 PAI入门

- 机器学习平台 PAI方法

- 机器学习平台 PAI深度学习

- 机器学习平台 PAI分类

- 机器学习平台 PAI平台

- 机器学习平台 PAI笔记

- 机器学习平台 PAI学习

- 机器学习平台 PAI特征

- 机器学习平台 PAI实践

- 机器学习平台 PAI决策

- 机器学习平台 PAIai

- 机器学习平台 PAI网络

- 机器学习平台 PAI线性回归