Serverless 应用引擎产品使用合集之在NAS中下载torch和diffusers依赖包,如何加载

问题一:在函数计算中,觉启动也不是想象中的那么慢,你们是用的什么解决方案呢 部署比如绘画的ai模型是什么流程,我想弄成一个flask的api,是通过镜像的方式部署,然后模型下载到nas上吗,启动是不是非常慢,模型8个g。但是我之前用你们那个模板部署了个stable diffusion,感觉启动也不是想象中的那么慢,你们是用的什么解决方案呢 参考回答: ...

使用函数计算部署深度学习模型时用到了pytorch,按照官方推荐的方法,并没有找到torch层?

使用函数计算部署深度学习模型时用到了pytorch,按照官方推荐的方法,并没有找到torch层? 请问这个现在是不支持了嘛

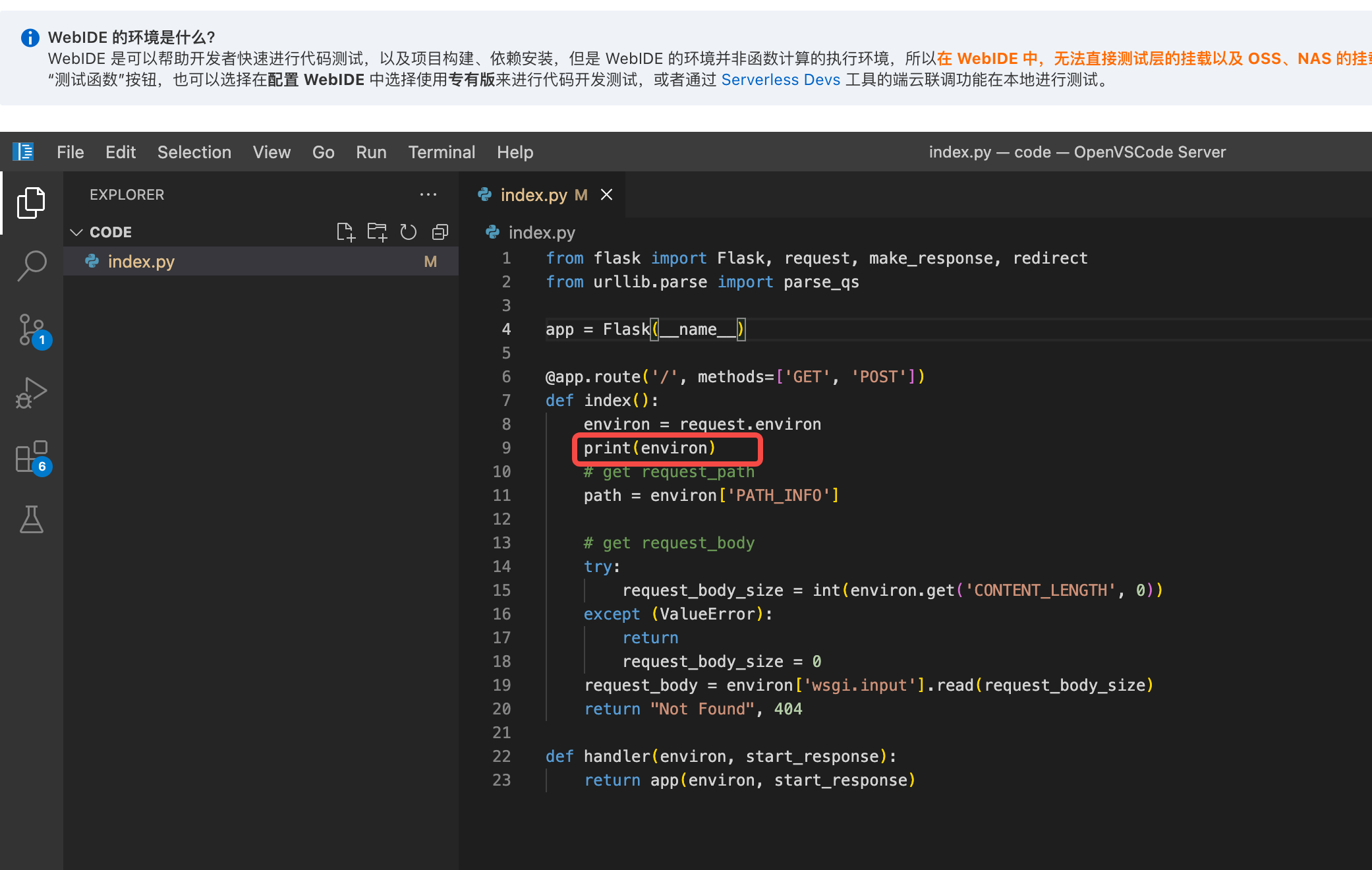

我想在serverless 应用部署一个flask应用, 依赖包含torch一些大于1G的pyth

我想在serverless 应用部署一个flask应用, 依赖包含torch一些大于1G的python包, 我已经通过s nas upload 上传了一些文件到/mnt/auto, 现在怎么把这个flash函数里面import包的时候能在/mnt/auto里面查找呢?

函数计算ai 环境怎么部署上去的,光torch就1.7G了函数计算大小限制好像只有500M

函数计算ai 环境怎么部署上去的?光torch就1.7G了函数计算大小限制好像只有500M。

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。