如何配置Kafka输出组件用于向数据源写入数据

Kafka输出组件可以将外部数据库中读取数据写入到Kafka,或从大数据平台对接的存储系统中将数据复制推送至Kafka,进行数据整合和再加工。本文为您介绍如何配置Kafka输出组件。

使用Cluster Linking复制Kafka集群数据

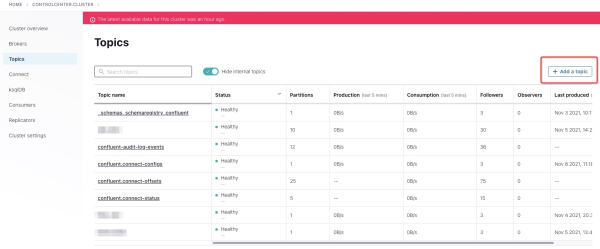

Cluster Linking是Confluent Platform提供的一种功能,用于将多个Kafka集群连接在一起。该功能允许不同的Kafka集群之间进行数据的镜像和复制。Cluster Linking将在数据目标(Destination)集群启动,并复制数据源(Source)集群的数据到目标集群。本文将向您介绍如何使用云消息队列 Confluent 版的Cluster Linking。主要包...

Spark Structured Streaming 和 Kafka 在数据完整性推理上有何不足?

Spark Structured Streaming 和 Kafka Streams 在数据完整性推理上有何不足?

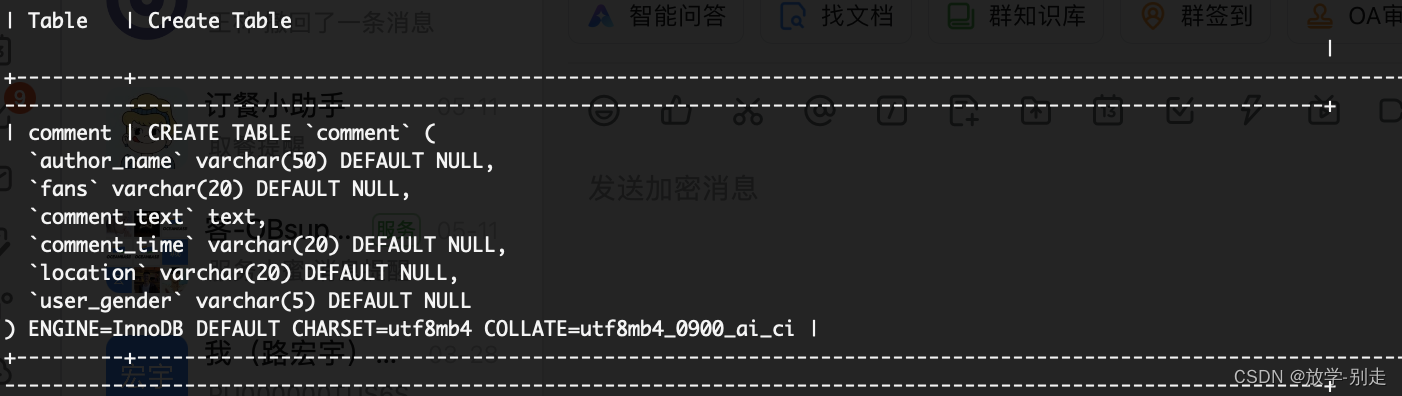

使用Apache Spark从MySQL到Kafka再到HDFS的数据转移

使用Apache Spark从MySQL到Kafka再到HDFS的数据转移 在本文中,将介绍如何构建一个实时数据pipeline,从MySQL数据库读取数据,通过Kafka传输数据,最终将数据存储到HDFS中。我们将使用Apache Spark的结构化流处理和流处理功能,以及Kafka和HDFS作为我们的数据传输和存储工具。 1、环境设置: 首先,确保在您的环境中正确安装...

使用Confluent Replicator复制数据

Kafka MirrorMaker是一款用于在两个Apache Kafka集群之间复制数据的独立工具。它将Kafka消费者和生产者连接在一起。从源集群的Topic读取数据,并写入目标集群的同名Topic。相比于Kafka MirrorMaker,Confluent Replicator是一个更完整的解决方案,它能复制Topic的配置和数据,还能与Kafka Connect和Control Cent...

flink有api可以像 spark那样批出 kafka数据吗?

我现在的问题是如果keyby开窗后,再加key字段的话就无法从之前的状态重启了,但我并不想要这里窗口的状态

企业版Spark Databricks + 企业版Kafka Confluent 联合高效挖掘数据价值

前提条件已注册阿里云账号,详情请参见阿里云账号注册流程已开通 Databricks 数据洞察服务已开通 OSS 对象存储服务已开通 Confluent 流数据服务创建Databricks集群 & Confluent集群登录Confluent管理控制台,创建Confluent集群,并开启公网服务登录Databricks管理控制台,创建Databricks集群Databricks Worke....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

云消息队列 Kafka 版数据相关内容

- 云消息队列 Kafka 版数据磁盘

- 云消息队列 Kafka 版数据计算

- flinksql云消息队列 Kafka 版数据

- 产品云消息队列 Kafka 版数据

- 实时计算flink版云消息队列 Kafka 版数据

- 实时计算云消息队列 Kafka 版数据

- 云消息队列 Kafka 版connector数据

- 云消息队列 Kafka 版数据数组

- 云消息队列 Kafka 版数据调节

- 数据云消息队列 Kafka 版分区有序

- cdc数据云消息队列 Kafka 版

- 数据云消息队列 Kafka 版

- 数据云消息队列 Kafka 版分区

- 同步数据云消息队列 Kafka 版

- 数仓云消息队列 Kafka 版数据

- python云消息队列 Kafka 版数据

- 报错云消息队列 Kafka 版数据

- 云消息队列 Kafka 版数据策略

- 云消息队列 Kafka 版机制数据

- 云消息队列 Kafka 版producer数据

- flinksql数据云消息队列 Kafka 版

- cdc云消息队列 Kafka 版数据配置

- 数据云消息队列 Kafka 版报错

- 云消息队列 Kafka 版数据配置

- 同步云消息队列 Kafka 版数据

- mysql云消息队列 Kafka 版数据

- 云消息队列 Kafka 版数据排查

- 阿里云云消息队列 Kafka 版数据

- 配置云消息队列 Kafka 版数据

- cdc同步云消息队列 Kafka 版数据

云消息队列 Kafka 版更多数据相关

- 云消息队列 Kafka 版数据报错

- 云消息队列 Kafka 版数据格式格式数据

- 云消息队列 Kafka 版格式数据

- 库云消息队列 Kafka 版数据

- 云消息队列 Kafka 版流处理数据

- 云消息队列 Kafka 版数据代码

- 云消息队列 Kafka 版任务数据

- streaming云消息队列 Kafka 版数据

- 数据云消息队列 Kafka 版snapshot

- 实时计算flink版数据云消息队列 Kafka 版

- flink云消息队列 Kafka 版数据

- 采集数据云消息队列 Kafka 版

- 云消息队列 Kafka 版数据mysql

- canal数据云消息队列 Kafka 版

- canal云消息队列 Kafka 版数据

- flink云消息队列 Kafka 版同步数据

- 实时计算flink云消息队列 Kafka 版数据

- canal同步数据云消息队列 Kafka 版

- 云消息队列 Kafka 版数据字段

- 云消息队列 Kafka 版数据参数

- 云消息队列 Kafka 版topic数据

- 云消息队列 Kafka 版数据清理

- 云消息队列 Kafka 版订阅数据

- 云消息队列 Kafka 版数据乱序

- 云消息队列 Kafka 版数据延迟

- 捕获数据云消息队列 Kafka 版

- 云消息队列 Kafka 版数据hive

- 连接云消息队列 Kafka 版数据

- flume云消息队列 Kafka 版数据

- 云消息队列 Kafka 版消费数据

云消息队列 Kafka 版您可能感兴趣

- 云消息队列 Kafka 版消费者

- 云消息队列 Kafka 版分配

- 云消息队列 Kafka 版分区

- 云消息队列 Kafka 版生产者

- 云消息队列 Kafka 版平台

- 云消息队列 Kafka 版分析

- 云消息队列 Kafka 版分布式

- 云消息队列 Kafka 版实战

- 云消息队列 Kafka 版flink

- 云消息队列 Kafka 版常见问题

- 云消息队列 Kafka 版cdc

- 云消息队列 Kafka 版集群

- 云消息队列 Kafka 版报错

- 云消息队列 Kafka 版topic

- 云消息队列 Kafka 版配置

- 云消息队列 Kafka 版同步

- 云消息队列 Kafka 版消息队列

- 云消息队列 Kafka 版消费

- 云消息队列 Kafka 版mysql

- 云消息队列 Kafka 版apache

- 云消息队列 Kafka 版安装

- 云消息队列 Kafka 版消息

- 云消息队列 Kafka 版日志

- 云消息队列 Kafka 版sql

- 云消息队列 Kafka 版原理

- 云消息队列 Kafka 版连接

- 云消息队列 Kafka 版解析

- 云消息队列 Kafka 版java

- 云消息队列 Kafka 版入门

- 云消息队列 Kafka 版架构