LLM 大模型学习必知必会系列(六):量化技术解析、QLoRA技术、量化库介绍使用(AutoGPTQ、AutoAWQ)

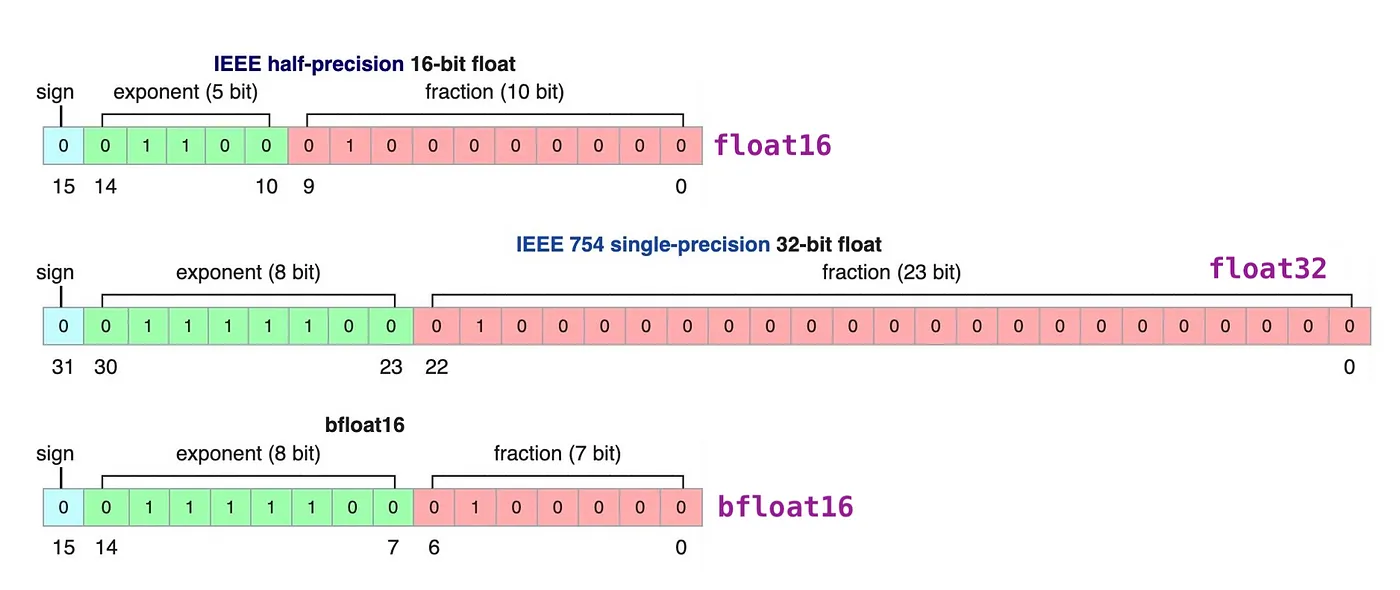

LLM 大模型学习必知必会系列(六):量化技术解析、QLoRA技术、量化库介绍使用(AutoGPTQ、AutoAWQ) 模型的推理过程是一个复杂函数的计算过程,这个计算一般以矩阵乘法为主,也就是涉及到了并行计算。一般来说,单核CPU可以进行的计算种类更多,速度更快,但一般都是单条计算;而显卡能进行的都是基础的并行计算,做矩阵乘法再好不过。如果把所有的矩阵都加载到显卡上,就会导致显卡显存的占用大.....

使用Accelerate库在多GPU上进行LLM推理

所以本文将在多个gpu上并行执行推理,主要包括:Accelerate库介绍,简单的方法与工作代码示例和使用多个gpu的性能基准测试。 本文将使用多个3090将llama2-7b的推理扩展在多个GPU上 基本示例 我们首先介绍一个简单的示例来演示使用Accelerate进行多gpu“消息传递”。 from accelerate import Accelerator from acc...

OpenSearch LLM智能问答增加第四个文档时候,显示上传成功,但文档库没反应?

OpenSearch LLM智能问答增加第四个文档时候,显示上传成功,但文档库没反应?是文档总数量只能设置三个吗?这怎么删除了一个再新增也新增不进去,出bug啦?

OpenSearch LLM智能问答导入的文件能分不同的库吗?

OpenSearch LLM智能问答导入的文件能分不同的库吗?比如不同库上传资料回答不同问题这样,回答同一个问题,得到不同库的资料不一样,答案就不一样这样。

LLM评估综述论文问世,分三方面全面总结,还带资料库

这是一篇关于评估大型语言模型的研究,文中参考了许多重要文献,值得一读。大型语言模型(LLM)已经得到了学术界和产业界的广泛关注,而为了开发出好用的 LLM,适当的评估方法必不可少。现在,一篇有关 LLM 评估的综述论文终于来了!其中分三方面对 LLM 评估的相关研究工作进行了全面的总结,可帮助相关研究者索引和参考。不仅如此,该论文作者还创建了一个开源资料库,让用户可以方便地添加和共享相关的新研究....

LLM之高性能向量检索库

高性能向量检索库milvus简介Milvus 是一个开源的向量数据库引擎,旨在提供高效的向量存储、检索和分析能力。它被设计用于处理大规模的高维向量数据,常用于机器学习、计算机视觉、自然语言处理和推荐系统等领域。Milvus 提供了多种功能和特性,使其成为处理向量数据的理想选择。以下是一些 Milvus 的主要特点:高性能:Milvus 使用了高度优化的数据结构和索引算法,以实现快速的向量检索。它....

小羊驼背后的英雄,伯克利开源LLM推理与服务库:GPU减半、吞吐数十倍猛增

大模型时代,各种优化方案被提出,这次吞吐量、内存占用大等问题被拿下了。 随着大语言模型(LLM)的不断发展,这些模型在很大程度上改变了人类使用 AI 的方式。然而,实际上为这些模型提供服务仍然存在挑战,即使在昂贵的硬件上也可能慢得惊人。现在这种限制正在被打破。最近,来自加州大学伯克利分校的研究者开源了一个项目 vLLM,该项目主要用于快速 LLM 推理和服务。vLLM 的核心是 Page...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。