ResNet代码复现+超详细注释(PyTorch)

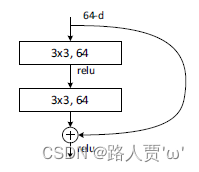

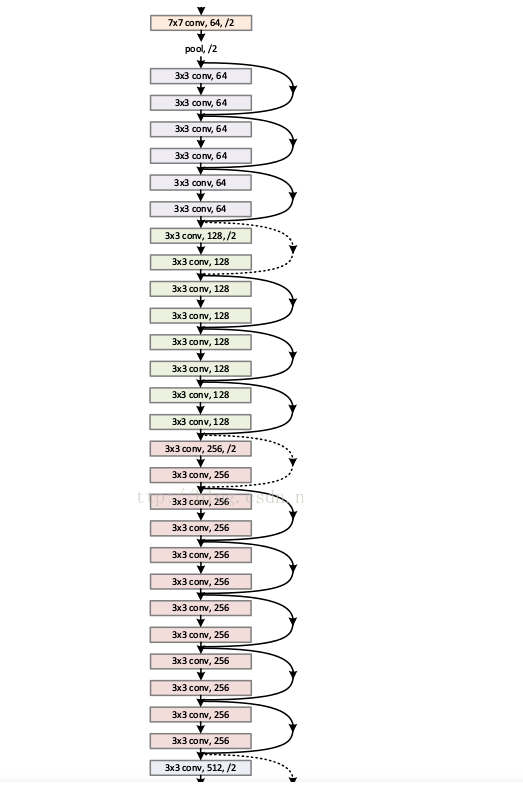

关于ResNet的原理和具体细节,可参见上篇解读:经典神经网络论文超详细解读(五)——ResNet(残差网络)学习笔记(翻译+精读+代码复现)接下来我们就来复现一下代码。源代码比较复杂,感兴趣的同学可以上官网学习: https://github.com/pytorch/vision/tree/master/torchvision本篇是简化版本 一、BasicBlock模块BasicBlock结.....

经典神经网络论文超详细解读(五)——ResNet(残差网络)学习笔记(翻译+精读+代码复现)

前言《Deep Residual Learning for Image Recognition》这篇论文是何恺明等大佬写的,在深度学习领域相当经典,在2016CVPR获得best paper。今天就让我们一起来学习一下吧!论文原文:https://arxiv.org/abs/1512.03385前情回顾:经典神经网络论文超详细解读(一)——AlexNet学习笔记(翻译+精读)经典神经网络论文超详....

深度学习:ResNet从理论到代码

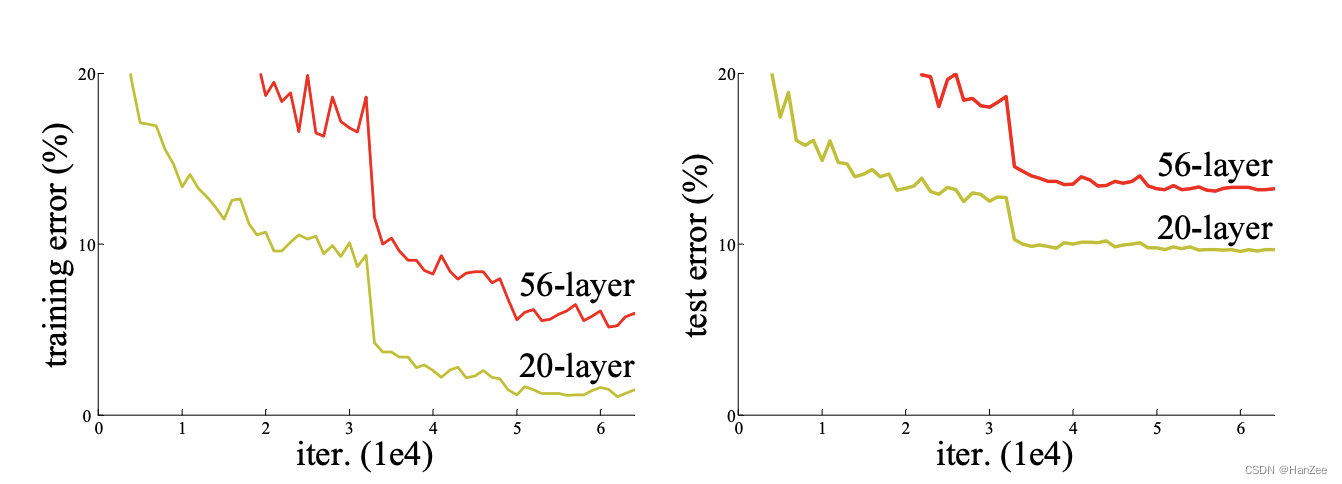

面临的问题模型退化问题随着网络层数加深,性能逐渐降低,但它并不是过拟合,因为在test error降低的同时,train error 也在降低。可能的原因:网络训练过程中正反向信息流动不通畅,网络没有被完全训练。ResNet作者的思想是如果在一个浅层模型可以找到一个很好的结果,那么他的对应版本的深层网络也会很好,因为只需要在浅层网络后面加恒等映射就可以(就是浅层网络后面的层即使不干好事,但也不会....

手撕Resnet卷积神经网络-pytorch-详细注释版(可以直接替换自己数据集)-直接放置自己的数据集就能直接跑。跑的代码有问题的可以在评论区指出,看到了会回复。训练代码和预测代码均有。

Resnet(Deep residual network, ResNet),深度残差神经网络,卷积神经网络历史在具有划时代意义的神经网络。与Alexnet和VGG不同的是,网络结构上就有很大的改变,在大家为了提升卷积神经网络的性能在不断提升网络深度的时候,大家发现随着网络深度的提升,网络的效果变得越来越差,甚至出现了网络的退化问题,80层的网络比30层的效果还差,深度网络存在的梯度消失和爆炸问题....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

ResNet您可能感兴趣

- ResNet模型

- ResNet图像

- ResNet分类

- ResNet networks

- ResNet resnet

- ResNet深度学习

- ResNet应用

- ResNet原理

- ResNet网络

- ResNet图像识别

- ResNet pytorch

- ResNet论文

- ResNet训练

- ResNet入门

- ResNet图像分类

- ResNet神经网络

- ResNet结构

- ResNet数据集

- ResNet mobilenet

- ResNet densenet

- ResNet部署

- ResNet复现

- ResNet任务

- ResNet优化

- ResNet算法

- ResNet vit

- ResNet参数

- ResNet块

- ResNet机器学习

- ResNet简介