EeSen、FSMN、CLDNN、BERT、Transformer-XL…你都掌握了吗?一文总结语音识别必备经典模型(3)

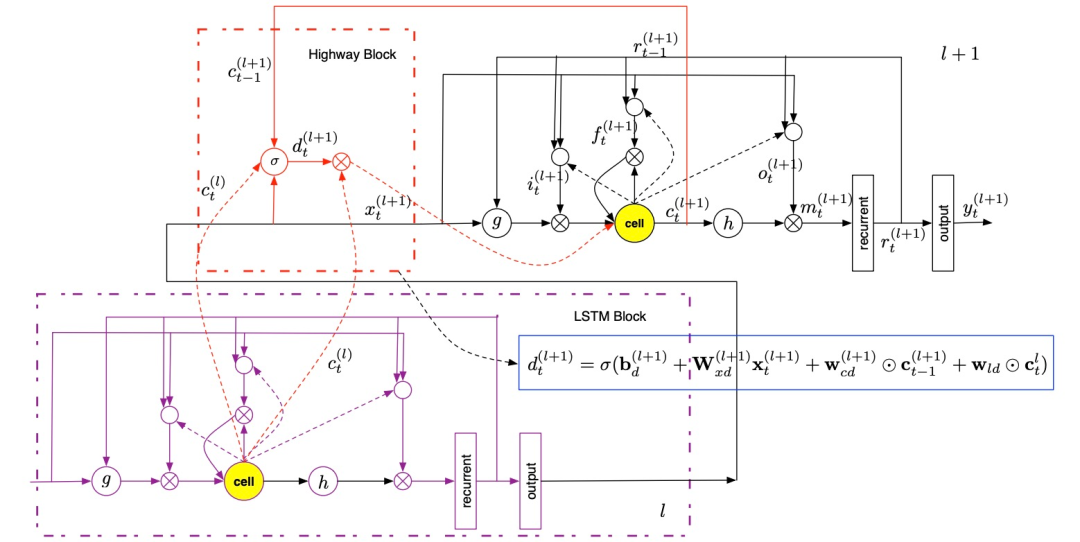

4、 highway LSTMhighwayLSTM是LSTM的变体,主要解决多层LSTM网络引起的梯度弥散问题。Highway翻译成中文就是”高速公路“,也就是说Highway LSTM提供了一条”高速公路“,让信息(细胞状态)可以在不同层之间畅通无阻的流通。通过在相邻层的记忆单元之间引入门控直接连接来扩展深度长短期记忆(DLSTM)循环神经网络。这些直接连接被称为highway连接,使不同层....

EeSen、FSMN、CLDNN、BERT、Transformer-XL…你都掌握了吗?一文总结语音识别必备经典模型(2)

二、神经声学模型1、EeSenEesen框架简化了构建最优ASR系统的流程。声学建模包括使用RNN学习预测上下文无关目标(音素或字符),为了消除对预先生成的帧标签的需求,本文采用了CTC目标函数来推断语音和标签序列之间的对齐方式。Eesen的一个显著特征是基于带权有限状态转录器(Weight finite state transducer,WFST)解码方式,该方法可将词典和语言模型有效地合并到....

EeSen、FSMN、CLDNN、BERT、Transformer-XL…你都掌握了吗?一文总结语音识别必备经典模型(1)

EeSen、FSMN、CLDNN、BERT、Transformer-XL…你都掌握了吗?一文总结语音识别必备经典模型(二)机器之心 2023-02-12 12:44 发表于北京以下文章来源于机器之心SOTA模型,作者机器之心SOTA模型 机器之心专栏本专栏由机器之心SOTA!模型资源站出品,每周日于机器之心公众号持续更新。 本专栏将逐一盘点自然语言处理、计算机视觉等领域下的常见任务,并....

Attention-lvcsr、Residual LSTM…你都掌握了吗?一文总结语音识别必备经典模型(3)

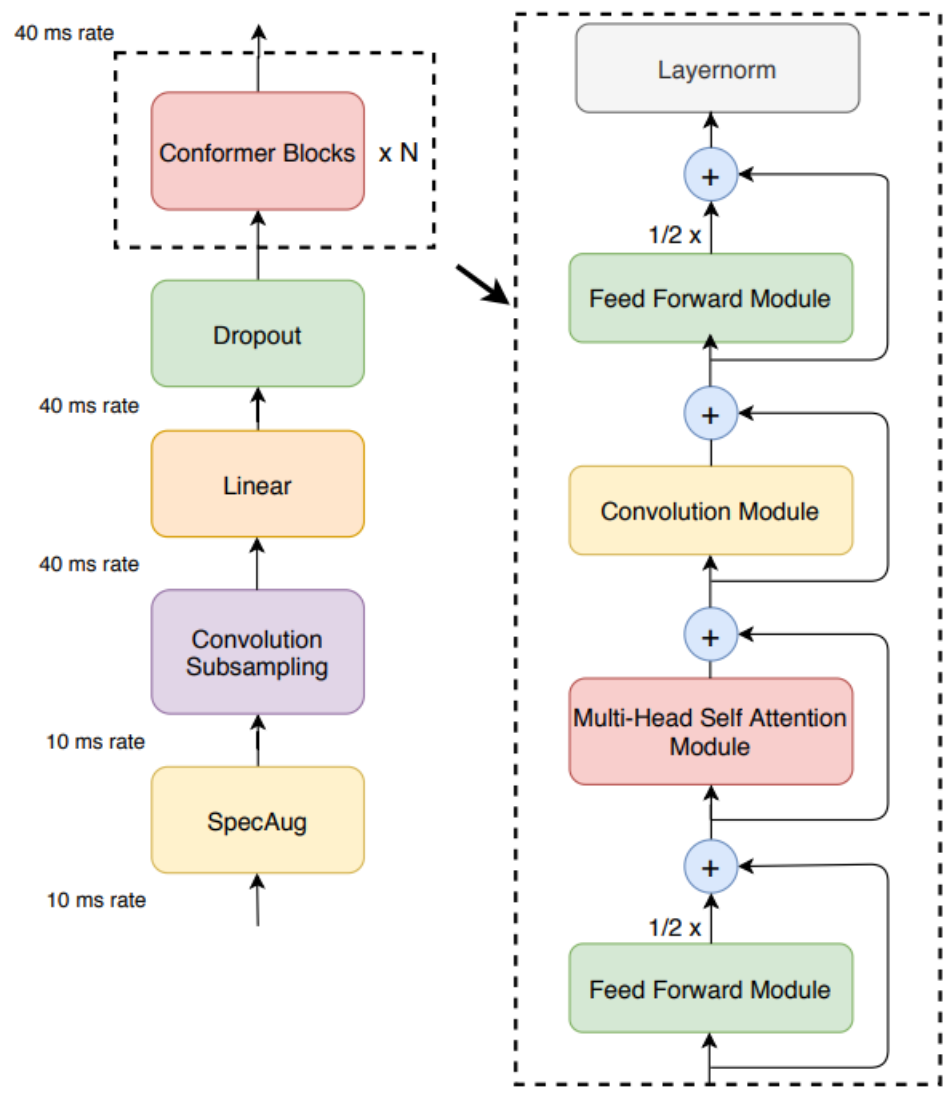

5、 Conformer应用于ASR领域,Transformer和CNN的模型显示出较好的结果,且优于RNN。Transformer模型擅长捕获基于内容的全局交互,而CNN有效利用局部特征。这项工作通过研究如何以参数高效的方式将卷积神经网络和Transformer组合起来,来建模音频序列的局部和全局依存,从而充分利用两者优势。为此,本文提出了用于语音识别的卷积增强的Transformer,称为C....

Attention-lvcsr、Residual LSTM…你都掌握了吗?一文总结语音识别必备经典模型(2)

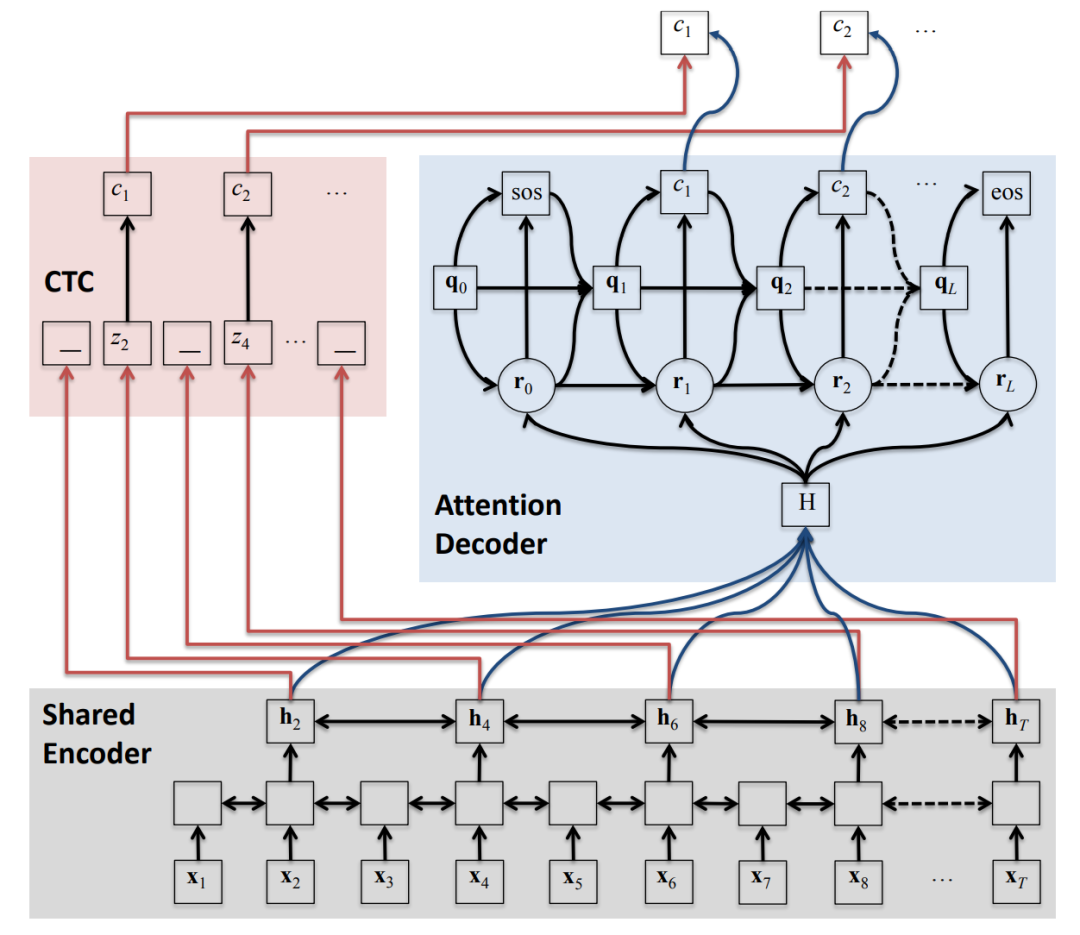

3、 CTC/Attention基于CTC/注意力的端到端混合架构将CTC目标函数作为一个正则项,加入到基于注意力的编解码器中。在没有任何启发式搜索技术的情况下,大大减少了不规则对齐语句的数量。在解码过程中,采用了一种联合解码方法,能够在rescoring/beam search算法中将基于注意力的分数和 CTC 分数结合来达到无条件独立假设下的强对齐约束 。图4. 基于CTC/注意....

Attention-lvcsr、Residual LSTM…你都掌握了吗?一文总结语音识别必备经典模型(1)

机器之心专栏本专栏由机器之心SOTA!模型资源站出品,每周日于机器之心公众号持续更新。 本专栏将逐一盘点自然语言处理、计算机视觉等领域下的常见任务,并对在这些任务上取得过 SOTA 的经典模型逐一详解。前往 SOTA!模型资源站(sota.jiqizhixin.com)即可获取本文中包含的模型实现代码、预训练模型及 API 等资源。本文将分 3 期进行连载,共介绍 17 个在....

NNLM、RNNLM、LSTM-RNNLM、Bi-lstm、GPT-1…你都掌握了吗?一文总结语音识别必备经典模型(2)

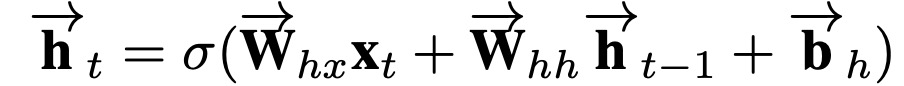

6、 GPT-1BiRNN+Attention使用了典型的编码器-解码器结构,编码器部分使用BiRNN,解码器部分使用Attention机制。对于普通的RNN模型,输入(x_1,x_2,...,x_T) 在经过 T 个时刻之后,可以得到 T 个正向隐藏层状态(h→,...,h→T) ;之后将输入序列单词的顺序颠倒之后得到(x_T,...,x_2,x_1) ,然后再次经过RNN,就可以得到反向的隐....

NNLM、RNNLM、LSTM-RNNLM、Bi-lstm、GPT-1…你都掌握了吗?一文总结语音识别必备经典模型(2)

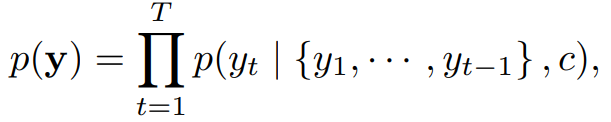

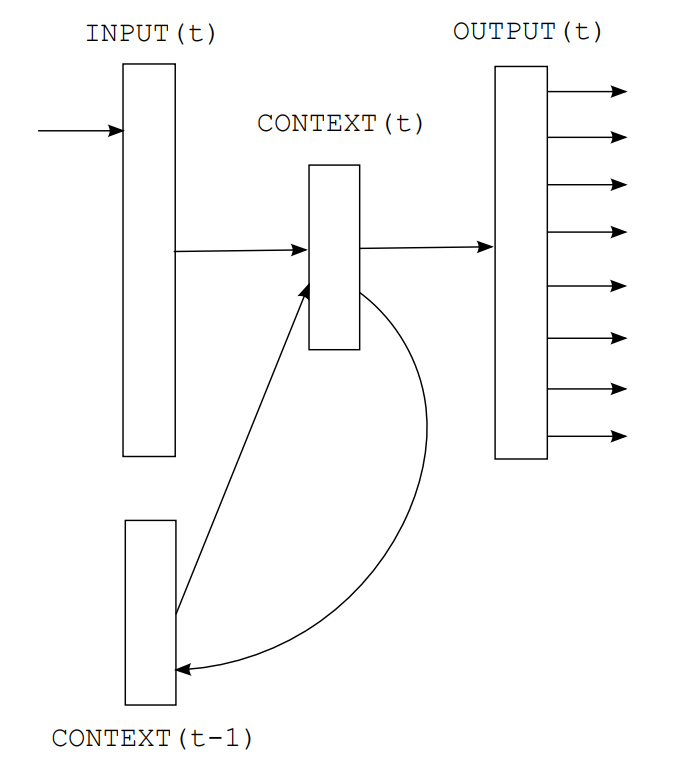

2、 RNNLMRNNLM模型的设计思想比较简单,主要是对NNLM中的前馈神经网络进行改进,其主要的结构图如下图2所示:图2. RNNLM结构NNLM的一个主要缺陷是,前馈网络必须使用固定长度的上下文,而这个长度需要在训练前临时指定。通常情况下,这意味着神经网络在预测下一个词时只能看到五到十个前面的词。众所周知,人类可以利用更长的上下文,而且非常成功。另外,缓存模型为神经网络模型提供了补充信息,....

NNLM、RNNLM、LSTM-RNNLM、Bi-lstm、GPT-1…你都掌握了吗?一文总结语音识别必备经典模型(1)

本专栏由机器之心SOTA!模型资源站出品,每周日于机器之心公众号持续更新。 本专栏将逐一盘点自然语言处理、计算机视觉等领域下的常见任务,并对在这些任务上取得过 SOTA 的经典模型逐一详解。前往 SOTA!模型资源站(sota.jiqizhixin.com)即可获取本文中包含的模型实现代码、预训练模型及 API 等资源。本文将分 3 期进行连载,共介绍 17 个在语音识别任务....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

智能语音交互经典模型相关内容

智能语音交互您可能感兴趣

- 智能语音交互模型

- 智能语音交互大模型

- 智能语音交互报错

- 智能语音交互协议

- 智能语音交互语音流

- 智能语音交互功能

- 智能语音交互产品

- 智能语音交互参数

- 智能语音交互配置

- 智能语音交互示例

- 智能语音交互语音

- 智能语音交互阿里

- 智能语音交互阿里云

- 智能语音交互识别

- 智能语音交互modelscope-funasr

- 智能语音交互服务

- 智能语音交互技术

- 智能语音交互sdk

- 智能语音交互语音合成

- 智能语音交互音频

- 智能语音交互应用

- 智能语音交互paraformer

- 智能语音交互接口

- 智能语音交互文件

- 智能语音交互文本

- 智能语音交互语音识别

- 智能语音交互智能语音交互

- 智能语音交互离线

- 智能语音交互系统

- 智能语音交互python