构建高效GPU算力平台:挑战、策略与未来展望

引言 随着深度学习、高性能计算和大数据分析等领域的快速发展,GPU(图形处理器)因其强大的并行计算能力和浮点运算速度而成为首选的计算平台。然而,随着模型规模的增长和技术的进步,构建高效稳定的GPU算力平台面临着新的挑战。本文旨在探讨这些挑战、应对策略以及对未来发展的展望。 当前挑战 算力分配与资源优化 在多用户共享GPU集群的...

探索GPU算力平台的创新应用:从游戏到自动驾驶的跨越

摘要 本文探讨了GPU(图形处理器)在现代计算中的角色转变,从最初的图形渲染到如今成为人工智能和高性能计算的重要组成部分。我们将通过几个具体的案例研究,包括游戏渲染、虚拟现实(VR)以及自动驾驶系统,来展示GPU是如何推动这些领域的进步和发展。 引言 GPU的发展历程当前GPU技术的主要特点 GPU在游戏中的应用 游戏渲染技术...

GPU算力平台:数字化转型的核心驱动力

引言 随着人工智能(AI)、大数据分析以及高性能计算需求的不断增长,图形处理器(GPU)因其卓越的并行计算能力而成为加速这些领域的关键技术。GPU算力平台不仅能够显著提升计算效率,还能帮助企业更好地处理大规模数据集,支持复杂的机器学习模型训练,并促进实时数据分析。本文将探讨GPU算力平...

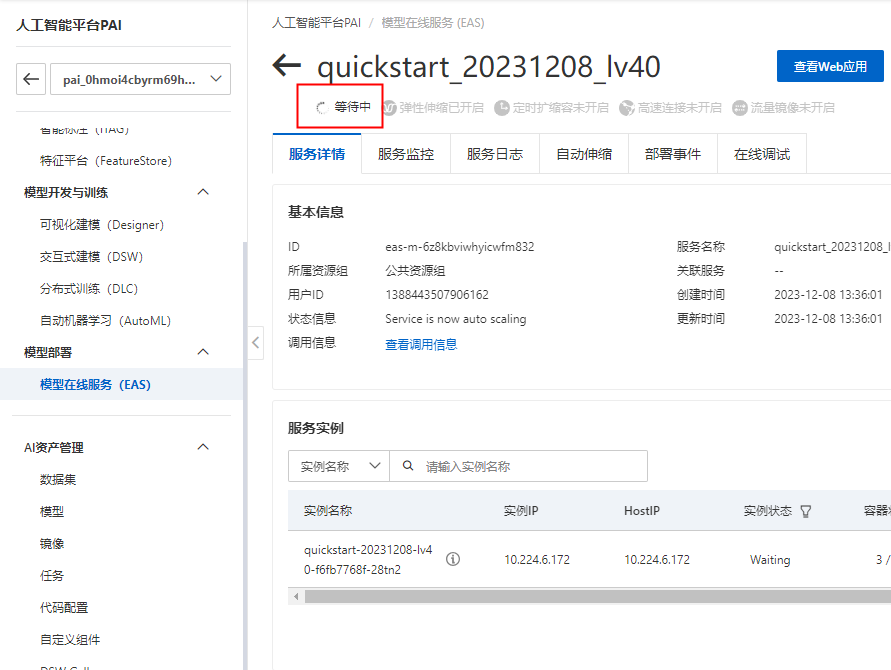

人工智能平台PAI产品使用合集之进入DSW后,如何把工作环境切换为GPU状态

问题一:请问机器学习PAI easyrec是否支持文本特征输入?另外中文需要提前分词吧? 请问机器学习PAI easyrec是否支持文本特征输入?另外中文需要提前分词吧? 参考回答: TextCNN特征聚合(Sequence Combiner) 特征配置模块支持使用TextCNN算子对序列特征进行embedding聚合,示例: feature_...

可以在ModelScope社区的自定义的gpu平台上跑起来github项目吗?

可以在ModelScope社区的自定义的gpu平台上跑起来github项目吗?

ModelScope平台提示 EAI-DSW 资源紧张,切换至 EAIS GPU环境如何理解?

ModelScope平台提示 EAI-DSW 资源紧张,切换至 EAIS GPU环境,前台显示显示16G(登进去,nvidia-smi 显示也是16G),“平台新用户可获赠32G显存GPU限时算力资源,实例单词运行最长时长10小时”,如何理解?

Bert-vits2最终版Bert-vits2-2.3云端训练和推理(Colab免费GPU算力平台)

对于深度学习初学者来说,JupyterNoteBook的脚本运行形式显然更加友好,依托Python语言的跨平台特性,JupyterNoteBook既可以在本地线下环境运行,也可以在线上服务器上运行。GoogleColab作为免费GPU算力平台的执牛耳者,更是让JupyterNoteBook的脚本运行形式如虎添翼。 本次我们利用Bert-vits2的最终版Bert-vits2-v2.3和Jup...

魔搭+Xinference 平台:CPU,GPU,Mac-M1多端大模型部署

导读随着 Llama2 的开源,以及通义千问、百川、智谱等国内大模型的问世,很多用户有了本地部署去尝试大模型的需求,然而硬件的需求阻碍了很多人的尝试,并不是所有人都拥有一块英伟达显卡的,所以 Llama2 问世不久,大神 Andrej Karpathy 的一个 weekend project 爆火——llama2.c。llama2.c 是用 C 语言实现的,没有任何依赖的大模型推理库,它能够以比....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

GPU云服务器您可能感兴趣

- GPU云服务器模式

- GPU云服务器推理

- GPU云服务器ai

- GPU云服务器最佳实践

- GPU云服务器模型

- GPU云服务器openai

- GPU云服务器数学

- GPU云服务器one

- GPU云服务器原理

- GPU云服务器节点

- GPU云服务器阿里云

- GPU云服务器服务器

- GPU云服务器实例

- GPU云服务器modelscope

- GPU云服务器cpu

- GPU云服务器函数计算

- GPU云服务器nvidia

- GPU云服务器性能

- GPU云服务器计算

- GPU云服务器版本

- GPU云服务器训练

- GPU云服务器部署

- GPU云服务器安装

- GPU云服务器资源

- GPU云服务器函数计算fc

- GPU云服务器配置

- GPU云服务器深度学习

- GPU云服务器购买

- GPU云服务器价格

- GPU云服务器参数