原理剖析| Kafka Exactly Once 语义实现原理:幂等性与事务消息

01 前言 在现代分布式系统中,确保数据处理的准确性和一致性是至关重要的。Apache Kafka,作为一个广泛使用的流处理平台,提供了强大的消息队列和流处理功能。随着业务需求的增长,Kafka 的事务消息功能应运而生,它允许应用程序以一种原子的方式处理消息,即要么所有消息都被正确处理,要么都不处理。本文将深入剖析 Kafka 的 Exact...

Kafka Exactly Once 语义实现原理:幂等性与事务消息

01 前言 在现代分布式系统中,确保数据处理的准确性和一致性是至关重要的。Apache Kafka,作为一个广泛使用的流处理平台,提供了强大的消息队列和流处理功能。随着业务需求的增长,Kafka 的事务消息功能应运而生,它允许应用程序以一种原子的方式处理消息,即要么所有消息都被正确处理,要么都不处理...

探究Kafka原理-7.exactly once semantics 和 性能测试

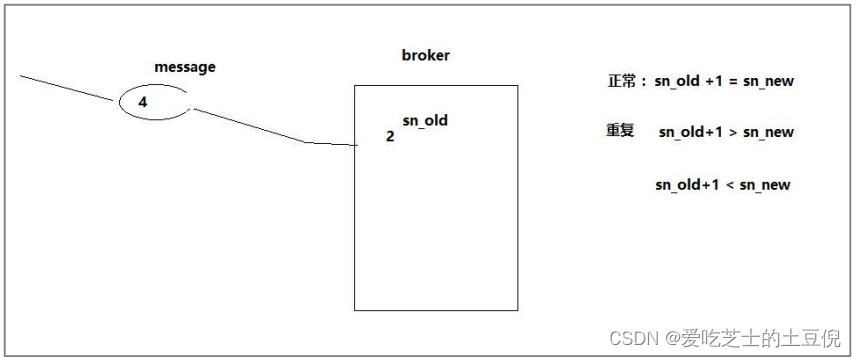

幂等性幂等性要点Kafka 0.11.0.0 版本开始引入了幂等性与事务这两个特性,以此来实现 EOS ( exactly once semantics ,精确一次处理语义)生产者在进行发送失败后的重试时(retries),有可能会重复写入消息,而使用 Kafka 幂等性功能之后就可以避免这种情况。开启幂等性功能,只需要显式地将生产者参数 enable.idempotence 设置为 true ....

深入解析 Kafka Exactly Once 语义设计 & 实现

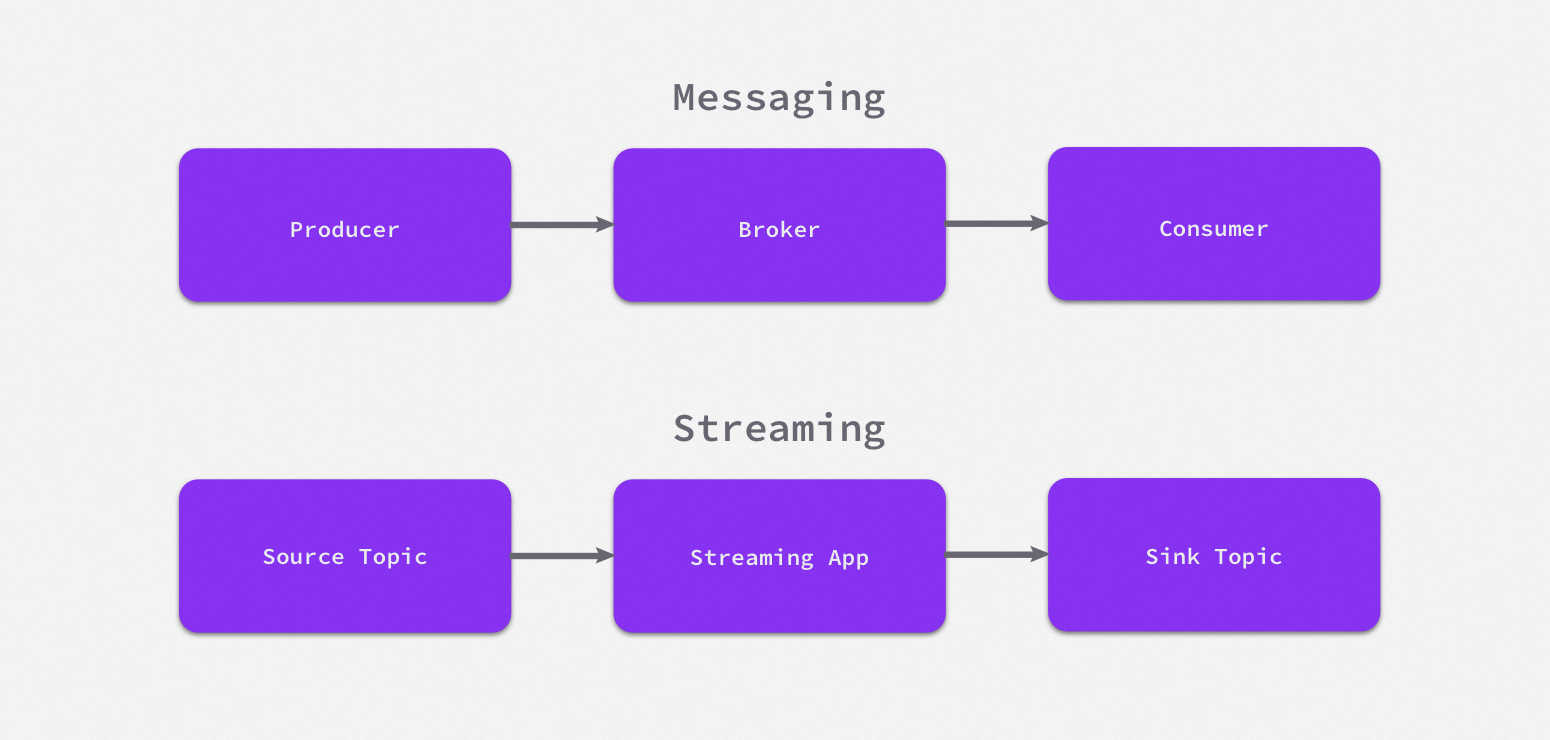

本篇文章主要介绍 Kafka 如何在流计算场景下保证端到端的 Exactly Once 语义,通过其架构上的设计以及源码分析帮助读者理解背后的实现原理。什么是 Exactly-Once?消息的投递语义主要分为三种:At Most Once: 消息投递至多一次,可能会丢但不会出现重复。At Least...

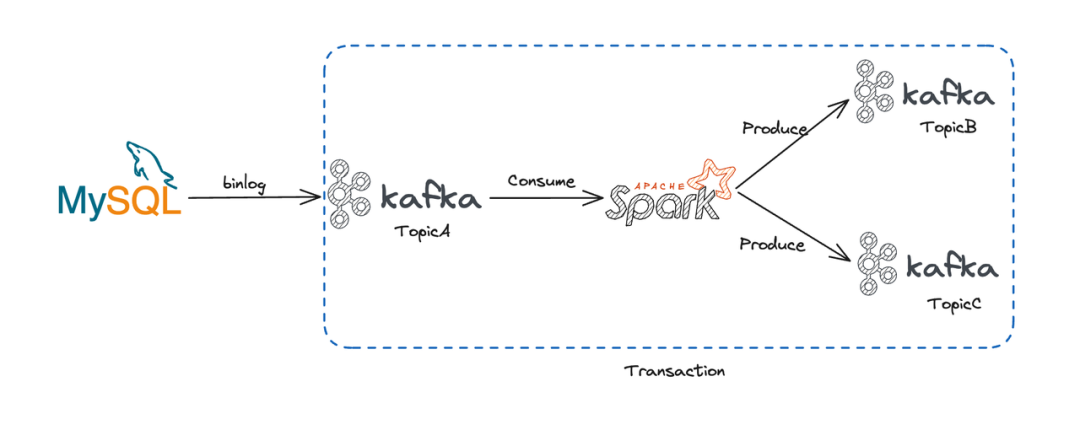

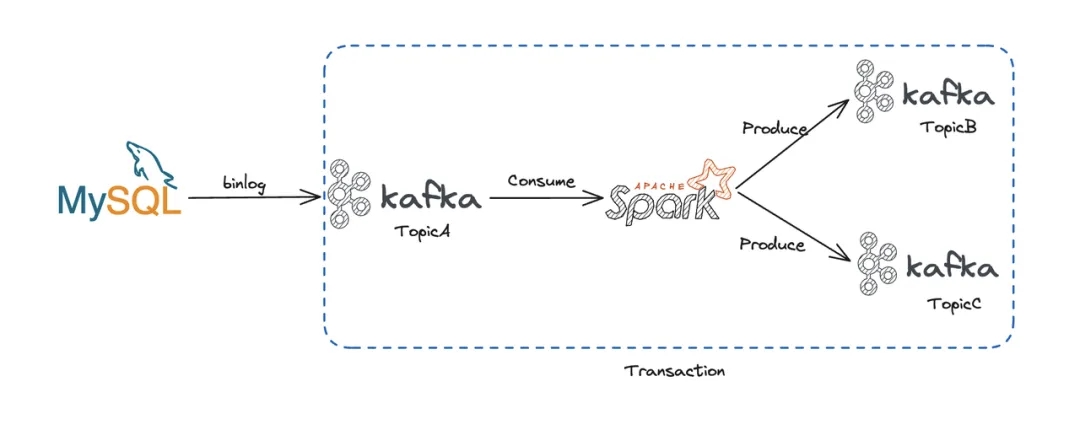

Flink CDC为了保证数据一致性,其中写入Kafka必须是Exactly Once吗?

Flink CDC消费MySQL写入到Kafka,再消费Kafka到另一个MySQL。为了保证数据一致性,其中写入Kafka必须是Exactly Once,还是At Least Once就可以?(因为binlog是ROW模式,即便是数据重复,只要保证数据顺序,是不是结果就是一致的?)

【Kafka】(二十二)Kafka Exactly Once 语义与事务机制原理2

异常处理Exception处理InvalidProducerEpoch这是一种Fatal Error,它说明当前Producer是一个过期的实例,有Transaction ID相同但epoch更新的Producer实例被创建并使用。此时Producer会停止并抛出Exception。InvalidPidMappingTransaction Coordinator没有与该Transaction I....

【Kafka】(二十二)Kafka Exactly Once 语义与事务机制原理1

写在前面的话本文所有Kafka原理性的描述除特殊说明外均基于Kafka 1.0.0版本。为什么要提供事务机制Kafka事务机制的实现主要是为了支持Exactly Once即正好一次语义操作的原子性有状态操作的可恢复性Exactly Once《Kafka背景及架构介绍》一文中有说明Kafka在0.11.0.0之前的版本中只支持At Least Once和At Most Once语义,尚不支持Exa....

用FlinkKafkaProducer011写kafka的exactly once的困惑

各位大神好,有个困惑。用FlinkKafkaProducer011写kafka的exactly once,比如我的checkpoint是十分钟,是否在十分钟之内,都不会往kafka下游发送数据。因为我看flink源码,是有在执行snapshotState的时候才kakfa的producer才flush了。*来自志愿者整理的flink邮件归档

Flink sink kafka EXACTLY ONCE 执行checkpoint失败

#环境 Flink 版本: 1.10.1 kafka 版本:2.12-2.2.2 DAG:source kafka->etl->sink kafka 在at least once模式下运行正常,改为extractly once执行checkpoint每次都不成功。 #配置 尝试过增加以下配置: props.setProperty(ProducerConfig.TRANSACTION_T...

kafka实现无消息丢失与精确一次语义(exactly once)处理

kafka实现无消息丢失与精确一次语义(exactly once)处理在很多的流处理框架的介绍中,都会说kafka是一个可靠的数据源,并且推荐使用Kafka当作数据源来进行使用。这是因为与其他消息引擎系统相比,kafka提供了可靠的数据保存及备份机制。并且通过消费者位移这一概念,可以让消费者在因某些原因宕机而重启后,可以轻易得回到宕机前的位置。 但其实kafka的可靠性也只能说是相对的,在整条数....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

云消息队列 Kafka 版once相关内容

云消息队列 Kafka 版您可能感兴趣

- 云消息队列 Kafka 版沙龙

- 云消息队列 Kafka 版kafka

- 云消息队列 Kafka 版消费者

- 云消息队列 Kafka 版生产者

- 云消息队列 Kafka 版下载

- 云消息队列 Kafka 版迁移

- 云消息队列 Kafka 版教程

- 云消息队列 Kafka 版topic

- 云消息队列 Kafka 版集群

- 云消息队列 Kafka 版幂等

- 云消息队列 Kafka 版flink

- 云消息队列 Kafka 版数据

- 云消息队列 Kafka 版cdc

- 云消息队列 Kafka 版分区

- 云消息队列 Kafka 版报错

- 云消息队列 Kafka 版配置

- 云消息队列 Kafka 版同步

- 云消息队列 Kafka 版消息队列

- 云消息队列 Kafka 版消费

- 云消息队列 Kafka 版mysql

- 云消息队列 Kafka 版apache

- 云消息队列 Kafka 版安装

- 云消息队列 Kafka 版消息

- 云消息队列 Kafka 版日志

- 云消息队列 Kafka 版sql

- 云消息队列 Kafka 版原理

- 云消息队列 Kafka 版连接

- 云消息队列 Kafka 版解析

- 云消息队列 Kafka 版java

- 云消息队列 Kafka 版入门

云消息队列

涵盖 RocketMQ、Kafka、RabbitMQ、MQTT、轻量消息队列(原MNS) 的消息队列产品体系,全系产品 Serverless 化。RocketMQ 一站式学习:https://rocketmq.io/

+关注