利用PyTorch Profiler实现大模型的性能分析和故障排查

本文介绍PyTorch Profiler结合TensorBoard分析模型性能,分别从数据加载、数据传输、GPU计算、模型编译等优化思路去提升模型训练的性能。最后总结了一些会导致CPU和GPU同步的常见的PyTorch API,在使用这些API时需要考虑是否会带来性能影响。

【AI大模型】深入Transformer架构:编码器部分的实现与解析(下)

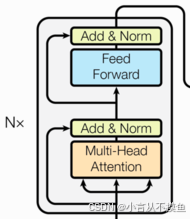

学习目标 了解编码器中各个组成部分的作用. 掌握编码器中各个组成部分的实现过程. 编码器介绍 编码器部分: * 由N个编码器层堆叠而成 * 每个编码器层由两个子层连接结构组成 * 第一个子层连接结构包括一个多头自注意力子层和规范化层以及一个残差连接 * 第二个子层连接结构包括一个前馈全连接子层和规范化层以及一个残差连接。 ...

【NLP】Datawhale-AI夏令营Day8-10打卡:大模型基础Transformer

概要在编码器(encoder)和解码器(decoder)之间一般采用CNN或者RNN,而本研究提出了一种简单的仅仅基于注意力机制的架构——Transformer,主要用于机器翻译上面。Transformer是一种完全基于注意力的序列转录模型,它用 多头自注意力(multi-headed self-attention) 取代了编码器-解码器架构中最常用的循环层。Transformer, a seq....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

AI大模型相关内容

AI更多大模型相关

产品推荐

人工智能平台PAI

人工智能平台 PAI(Platform for AI,原机器学习平台PAI)是面向开发者和企业的机器学习/深度学习工程平台,提供包含数据标注、模型构建、模型训练、模型部署、推理优化在内的AI开发全链路服务,内置140+种优化算法,具备丰富的行业场景插件,为用户提供低门槛、高性能的云原生AI工程化能力。

+关注