本地部署通义千问QwQ-32B模型

通义千问QwQ-32B是阿里云开源的320亿参数推理模型,通过大规模强化学习在数学推理、编程及通用任务中实现性能突破,支持消费级显卡本地部署,兼顾高效推理与低资源消耗。本文将介绍如何利用vLLM作为通义千问QwQ-32B模型的推理框架,在一台阿里云GPU实例上构建通义千问QwQ-32B的推理服务。

双机分布式部署满血版Deepseek模型

DeepSeek-V3/R1是一个具有超过600亿参数的专家混合(MoE)模型,且已开源其模型权重。本文将介绍如何利用vllm作为DeepSeek模型的推理框架,在两台ebmgn8v实例上构建DeepSeek-V3/R1的推理服务。您无需进行额外配置,即可实现开箱即用。

双机分布式部署满血版Deepseek模型

DeepSeek-V3/R1是一个具有超过600亿参数的专家混合(MoE)模型,且已开源其模型权重。本文将介绍如何利用vllm作为DeepSeek模型的推理框架,在两台ebmgn8v实例上构建DeepSeek-V3/R1的推理服务。您无需进行额外配置,即可实现开箱即用。

本地单机部署满血版DeepSeek模型

DeepSeek-V3/R1是一个具有超过600亿参数的专家混合(MoE)模型,且已开源其模型权重。本文将介绍如何利用SGLang作为DeepSeek模型的推理框架,在一台ebmgn8v实例上构建DeepSeek-V3/R1的推理服务。您无需进行额外配置,即可实现开箱即用。

如何本地部署DeepSeek

DeepSeek-V3/R1是拥有600B以上参数量的专家混合(MoE)模型,并已经开源了模型权重。本文为您介绍在GPU实例上部署DeepSeek-R1蒸馏模型推理服务。

为什么深度学习模型在GPU上运行更快?

引言 当前,提到深度学习,我们很自然地会想到利用GPU来提升运算效率。GPU最初是为了加速图像渲染和2D、3D图形处理而设计的。但它们强大的并行处理能力,使得它们在深度学习等更广泛的领域中也发挥了重要作用。 深度学习模型开始采用GPU是在2000年代中期到晚期,到了2012年,随着AlexNet的诞生,这种使用变得极为普遍。AlexNet是由Alex Krizhevsky、Ilya Su...

【从零开始学习深度学习】20. Pytorch中如何让参数与模型在GPU上进行计算

前言 之前我们一直在使用CPU计算。对复杂的神经网络和大规模的数据来说,使用CPU来计算可能不够高效。本文我们将介绍如何使用单块NVIDIA GPU来计算。所以需要确保已经安装好了PyTorch GPU版本。准备工作都完成后,下面就可以通过nvidia-smi命令来查看显卡信息了。 ...

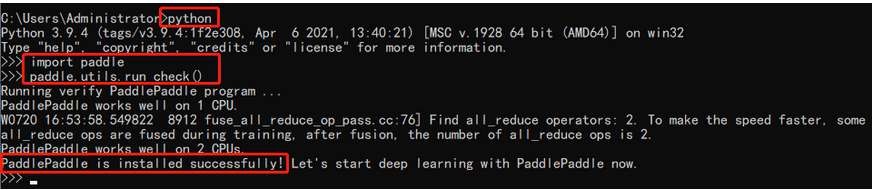

Python 深度学习AI - 利用训练好的模型库进行图像分割、一键抠图实例演示,百度深度学习平台飞浆paddlepaddle-gpu的安装与使用

Python 深度学习AI - 图像分割第一章:深度学习平台飞浆 paddle 的环境搭建① 效率更高的 gpu 版本的安装② 判断是否支持 gpu 版本③ 退而求其次,普通版本的安装④ paddlehub 的安装第二章:调用训练好的库进行图像分割效果演示① 演示一:ace2p 模型② 演示二:humanseg_server 模型 ③ 演示....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

GPU云服务器模型相关内容

- 模型GPU云服务器大模型

- 开源模型GPU云服务器

- 模型GPU云服务器

- GPU云服务器模型部署

- ai GPU云服务器模型

- 函数计算GPU云服务器模型

- GPU云服务器运行模型

- modelscope模型GPU云服务器

- modelscope-funasr GPU云服务器服务模型

- modelscope-funasr GPU云服务器模型

- GPU云服务器模型onnx

- GPU云服务器部署模型

- 模型部署GPU云服务器

- 模型下载GPU云服务器

- modelscope模型GPU云服务器运行

- GPU云服务器文本模型

- pytorch模型GPU云服务器

- 加载模型GPU云服务器

- 函数计算fc模型GPU云服务器

- 模型GPU云服务器推理

- 导出模型GPU云服务器

- modelscope模型GPU云服务器推理

- 模型设置GPU云服务器

- GPU云服务器模型文件

- modelscope模型GPU云服务器报错

- 模型GPU云服务器报错

- GPU云服务器加载模型

- GPU云服务器训练模型

- 自定义GPU云服务器模型文件

- GPU云服务器实验室模型

GPU云服务器更多模型相关

GPU云服务器您可能感兴趣

- GPU云服务器部署

- GPU云服务器推理

- GPU云服务器程序

- GPU云服务器查询

- GPU云服务器价格

- GPU云服务器服务器

- GPU云服务器共享

- GPU云服务器方案

- GPU云服务器nvidia

- GPU云服务器收费

- GPU云服务器阿里云

- GPU云服务器实例

- GPU云服务器modelscope

- GPU云服务器cpu

- GPU云服务器函数计算

- GPU云服务器ai

- GPU云服务器性能

- GPU云服务器训练

- GPU云服务器计算

- GPU云服务器版本

- GPU云服务器安装

- GPU云服务器函数计算fc

- GPU云服务器配置

- GPU云服务器资源

- GPU云服务器深度学习

- GPU云服务器购买

- GPU云服务器参数

- GPU云服务器教程

- GPU云服务器cuda

- GPU云服务器运行