Paper:2017年的Google机器翻译团队《Transformer:Attention Is All You Need》翻译并解读(四)

6.2、Model VariationsTo evaluate the importance of different components of the Transformer, we varied our base model in different ways, measuring the change in performance on English-to-German transla....

Paper:2017年的Google机器翻译团队《Transformer:Attention Is All You Need》翻译并解读(三)

3.4、Embeddings and SoftmaxSimilarly to other sequence transduction models, we use learned embeddings to convert the input tokens and output tokens to vectors of dimension dmodel. We also use the usua....

Paper:2017年的Google机器翻译团队《Transformer:Attention Is All You Need》翻译并解读(二)

2、BackgroundThe goal of reducing sequential computation also forms the foundation of the Extended Neural GPU [16], ByteNet [18] and ConvS2S [9], all of which use convolutional neural networks as basi....

Paper:2017年的Google机器翻译团队《Transformer:Attention Is All You Need》翻译并解读(一)

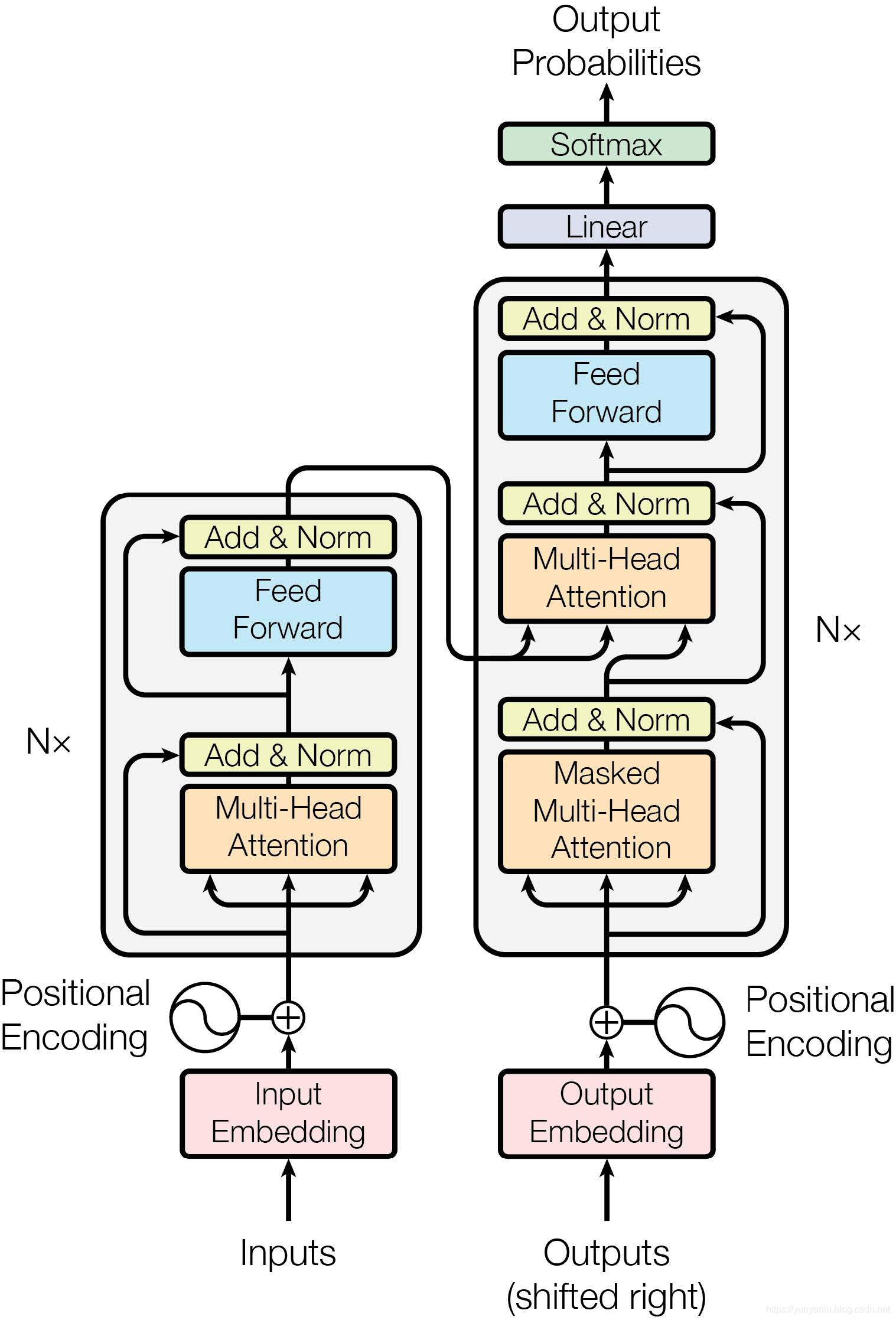

论文评价 2017年,Google机器翻译团队发表的《Attention is all you need》中大量使用了自注意力(self-attention)机制来学习文本表示。参考文章:《attention is all you need》解读1、Motivation:靠attention机制,不使用rnn和cnn,并行度高通过attention,抓长....

揭秘阿里机器翻译团队:拿下5项全球冠军,每天帮商家翻译7.5亿次

跨境电商市场越来越大,商家们也遇到了新问题。以阿里巴巴国际站为例,七成买家以英语沟通,剩下三成的小语种,却难住了平台上近96%的卖家。 “翻译和本地化都做不好,说明你对海外市场根本不重视,还想怎么品牌出海?”一米八大高个的李兮芝,语速极快,说话从不绕弯。 李兮芝是阿里巴巴国际贸易事业部(ICBU)阿里语言服务总经理,对商家的痛点了如指掌。讲到最棘手的案例,他会立刻站起来,抄起一支笔,在会议室的白....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。