【学习记录】《DeepLearning.ai》第十课:卷积神经网络(Convolutional Neural Networks)

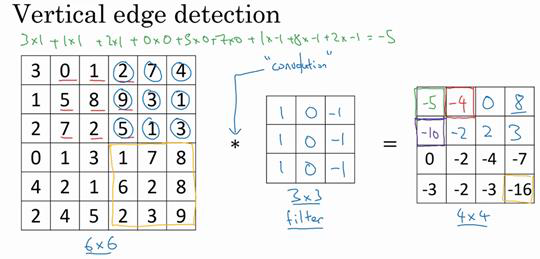

第十课:卷积神经网络(Convolutional Neural Networks)1.1 计算机视觉(Computer vision)通常如果处理大图用传统的神经网络需要特别大的输入,因此需要大量内存。对于计算机视觉应用来说,要处理大图片,就需要进行卷积计算。1.2 边缘检测示例垂直边沿检测器:上图是一个垂直边沿检测器,注意它的计算过程。卷积过程,$6*6$的图形经过一个过滤器(或者叫卷积核....

【学习记录】《DeepLearning.ai》第四课:深层神经网络(Deep L-layer neural network)

第四课:深层神经网络(Deep L-layer neural network)4.1 深层神经网络主要需要掌握一些符号,如下图:4.2 前向传播和反向传播(Forward and backward propagation) 反向传播的向量化实现:4.3 深层网络中的前向传播(Forward propagation in a Deep Network)对于前项传播向量化实现过程可以归纳为多...

【学习记录】《DeepLearning.ai》第三课:浅层神经网络(Shallow neural networks)

第三课:浅层神经网络(Shallow neural networks)3.1 神经网络概述PASS3.2 神经网络的表示如上图,从左到右依次为输入层、隐藏层、只有一个节点的层为输出层,负责输出预测值。一般称上图网络为两层神经网络,一般不把输入层看做一个标准层,因此该网络有一个隐藏层和输出层。在隐藏层有两个参数$W$和$b$,通常表示为$W^{[1]},b^{[1]}$,$W$为$4*3$....

【学习记录】《DeepLearning.ai》深度学习第二课(2):神经网络的编程基础

深度学习第二课(2):神经网络的编程基础2.11 向量化(Vectorization)逻辑回归中计算$z=w^Tx+b$,其中$w,x$都是列向量,下面是两种方法的对比:1.循环z=0 for i in range(n_x): z+=w[i]*x[i] z+=b2.向量化z=np.dot(w,x)+b很明显向量化方法较快举例说明:import numpy as np #导入numpy...

【学习记录】《DeepLearning.ai》深度学习第二课(1):神经网络的编程基础

深度学习第二课(1):神经网络的编程基础2.1 二分类(binary classification)遍历m个样本的训练集,神经网络通常不进行for循环遍历,神经网络计算中先进行前向传播,后进行反向传播。逻辑回归是一个用于二分类的算法例:加入图片大小为64*64像素,保存图片需要分别保存三个矩阵(红、绿、蓝三个颜色通道)将所有颜色通道保存,得到$x$的总维度为$64*64*3$,因此$n_x=12....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。