RT-DETR改进策略【模型轻量化】| 替换骨干网络为MoblieNetV1,用于移动视觉应用的高效卷积神经网络

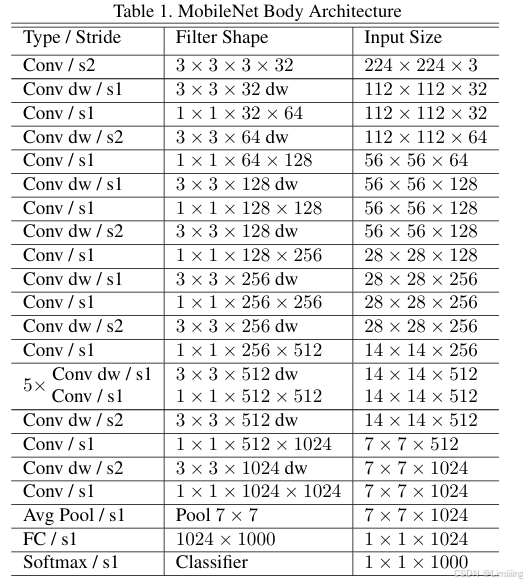

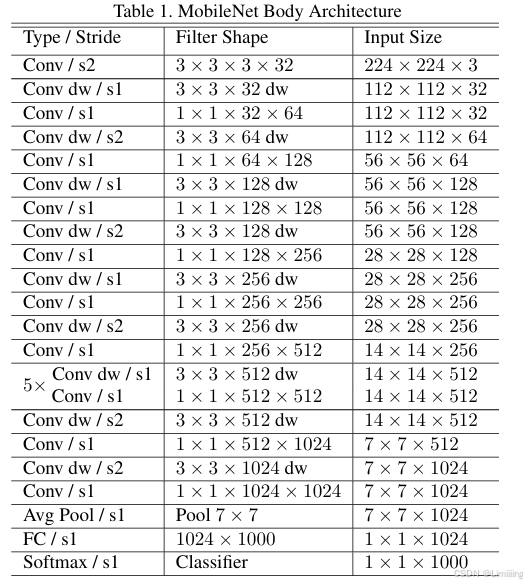

一、本文介绍 本文记录的是基于MobileNet V1的RT-DETR轻量化改进方法研究。MobileNet V1基于深度可分离卷积构建,其设计旨在满足移动和嵌入式视觉应用对小型、低延迟模型的需求,具有独特的模型收缩超参数来灵活调整模型大小与性能。本文将MobileNet V1应用到RT-DETR中,有望借助其高效的结构和特性,提升RT-DETR在计算资源有限环境下的性能表现,同时保持一定的精度....

YOLOv11改进策略【模型轻量化】| 替换骨干网络为MoblieNetV1,用于移动视觉应用的高效卷积神经网络

一、本文介绍 本文记录的是基于MobileNet V1的YOLOv11轻量化改进方法研究。MobileNet V1基于深度可分离卷积构建,其设计旨在满足移动和嵌入式视觉应用对小型、低延迟模型的需求,具有独特的模型收缩超参数来灵活调整模型大小与性能。本文将MobileNet V1应用到YOLOv11中,有望借助其高效的结构和特性,提升YOLOv11在计算资源有限环境下的性能表现,同时保持一定的精度....

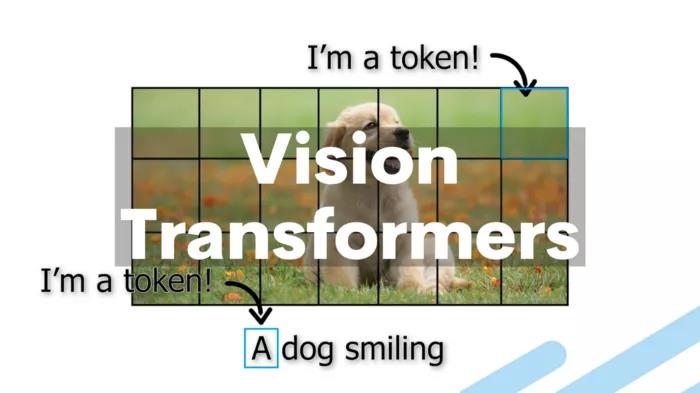

【YOLOv8改进】骨干网络: SwinTransformer (基于位移窗口的层次化视觉变换器)

YOLO目标检测创新改进与实战案例专栏 专栏目录: YOLO有效改进系列及项目实战目录 包含卷积,主干 注意力,检测头等创新机制 以及 各种目标检测分割项目实战案例 专栏链接: YOLO目标检测创新改进与实战案例 摘要 本文提出了一种新型视觉Transformer,称为Swin Transformer,它能够作为计算机视...

用Transformer振兴CNN骨干网络,港大、腾讯等联合提出视觉自监督表征学习CARE

自监督表征学习近两年十分火热。机器学习界的三位泰斗 Geoffroy Hinton、 Yann Lecun 、 Yoshua Bengio 一致认为自监督学习有望使 AI 产生类人的推理能力,其中 Hinton 与 Lecun 近两年也在 ICML / NeurIPS 中发表自监督表征学习的研究工作。可以说在机器学习顶会发表自监督表征学习的文章,是与 Hinton 和 Lecun 站到了同一赛道....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

域名解析DNS

关注DNS行业趋势、技术、标准、产品和最佳实践,连接国内外相关技术社群信息,追踪业内DNS产品动态,加强信息共享,欢迎大家关注、推荐和投稿。

+关注