学习笔记: 机器学习经典算法-集成学习策略

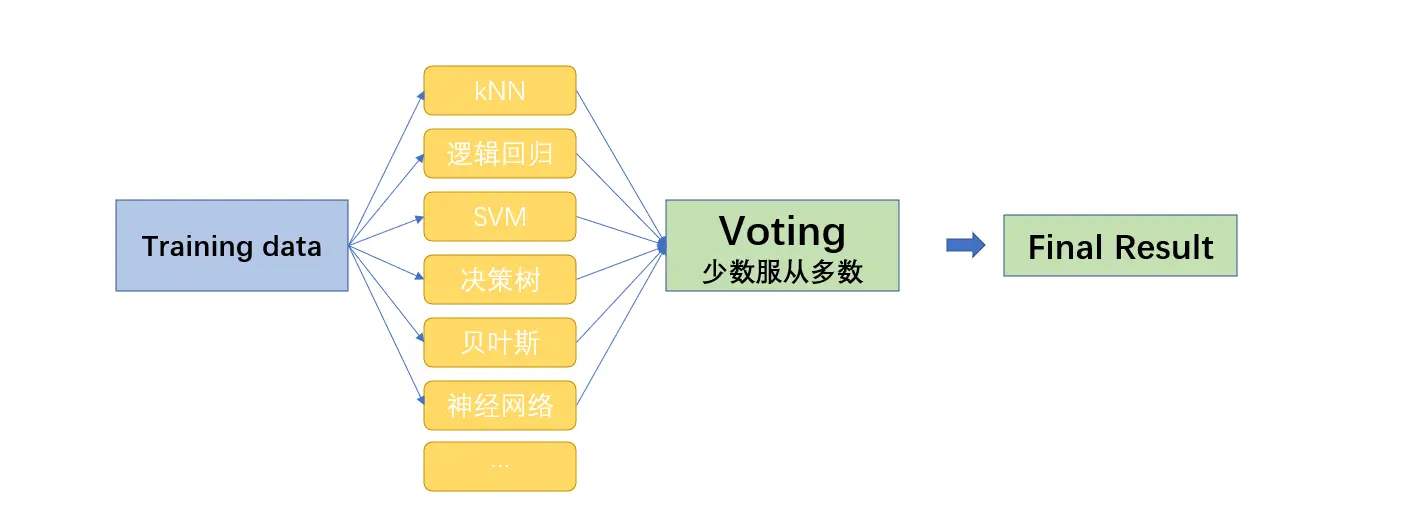

集成学习(Ensemble Learning) 指的是一种学习方法,它的思想在于通过采用投票的方式综合多个分类回归模型的结果以提高分类回归的准确率。集成学习这种方法与我们平时通过听取许多他人意见来决策的过程是一致的,综合更多的有效信息往往才能更好的对事物进行判断。 1、scikit-learn 下的集成学习接口(Voting Classifier) 集成学习根据统计投票结果的时...

集成学习算法策略 Boosting和Bagging

正文集成学习是机器学习中的一个重要分支。它主要包含两种策略:Boosting和Bagging。Boosting和Bagging都是基于多个弱学习器(弱分类器)(例如:一颗欠拟合的决策树)的基础之上的,且要满足,每一个弱学习器的分类准确性都要强于随机分类(即准确率大于50%)策略Boosting方法Bagging方法训练方式主要通过改变训练样本的权重(初始化时给所有训练样本相同的权重),学习多个弱....

10 集成学习 - XGBoost的学习策略

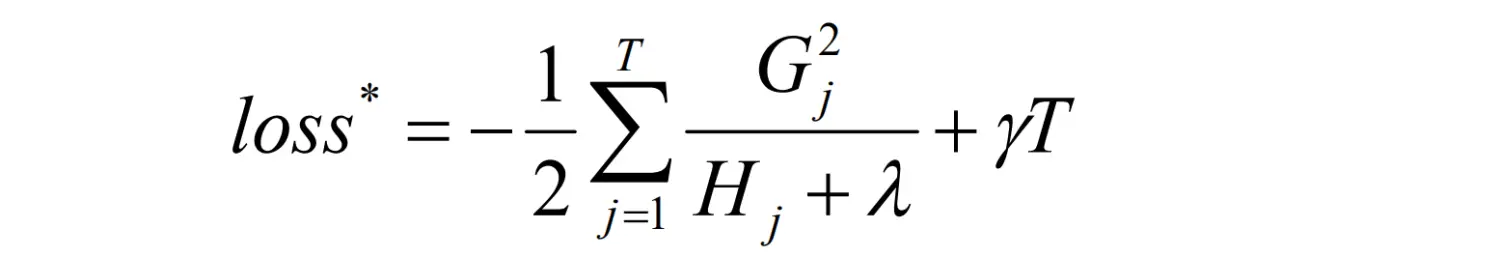

09 集成学习 - XGBoost公式推导 当树的结构确定的时候,我们可以得到最优的叶子点分数以及对应的最小损失值,问题在于如何确定树结构?1、暴力穷举所有可能的结构,选择损失值最小的;(很难求解)2、贪心法,每次尝试选择一个分裂点进行分裂,计算操作前后的增益,选择增益最大的方式进行分。 决策树相关算法计算指标:1、ID3算法:信息增益2、C4.5算法:信息增益率3、CART算法:Gini系数 ....

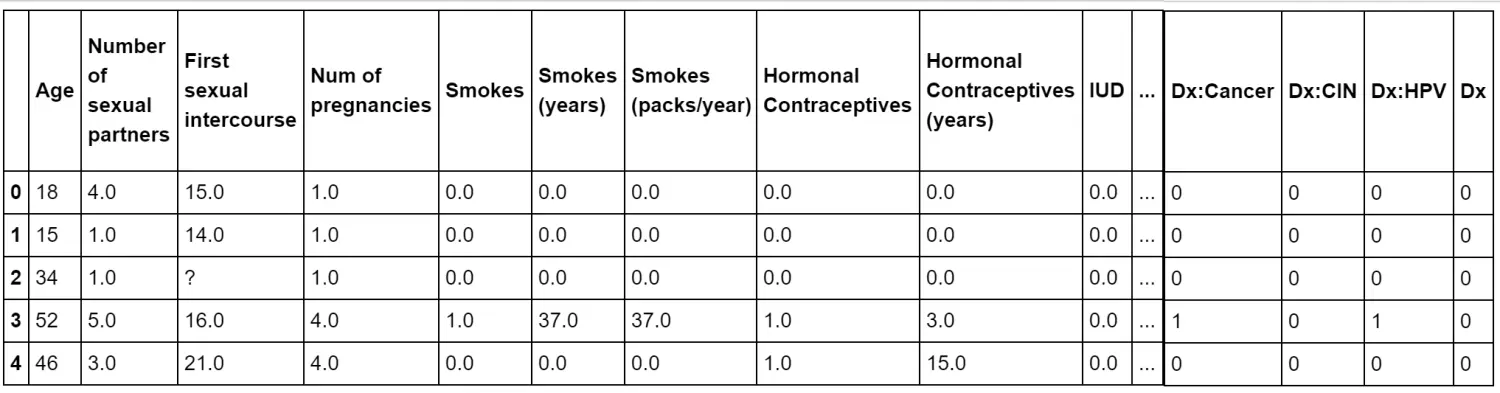

07 集成学习 - 随机森林案例一:宫颈癌预测 - 缺省数据填充策略、PCA降维、ROC曲线、标签二值化

01 集成学习 - 概述、Bagging - 随机森林、袋外错误率02 集成学习 - 特征重要度、Extra Tree、TRTE、IForest、随机森林总结03 集成学习 - Boosting - AdaBoost算法原理04 集成学习 - Boosting - AdaBoost算法构建05 集成学习 - Boosting - GBDT初探06 集成学习 - Boosting - GBDT算法....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

集成学习相关内容

- 集成学习性能

- 学习集成swagger

- 学习集成

- 机器学习集成学习

- 模型集成学习

- 集成学习stacking

- 集成学习随机森林

- 集成学习梯度

- 集成学习机器学习

- 集成学习learning

- 集成学习分类

- 机器学习集成学习模型

- 分类集成学习

- 集成学习bagging boosting

- 机器学习集成学习boosting

- 集成学习boosting

- 集成学习原理

- 集成学习树

- 集成学习gradient

- 集成学习梯度树

- 集成学习决策树

- 集成学习gradient boosting

- scikit-learn集成学习

- 教程集成迁移学习

- 教程集成学习

- 集成迁移学习

- xgboost集成学习

- 集成学习模型

- 学习集成gitlab

- 集成学习task1