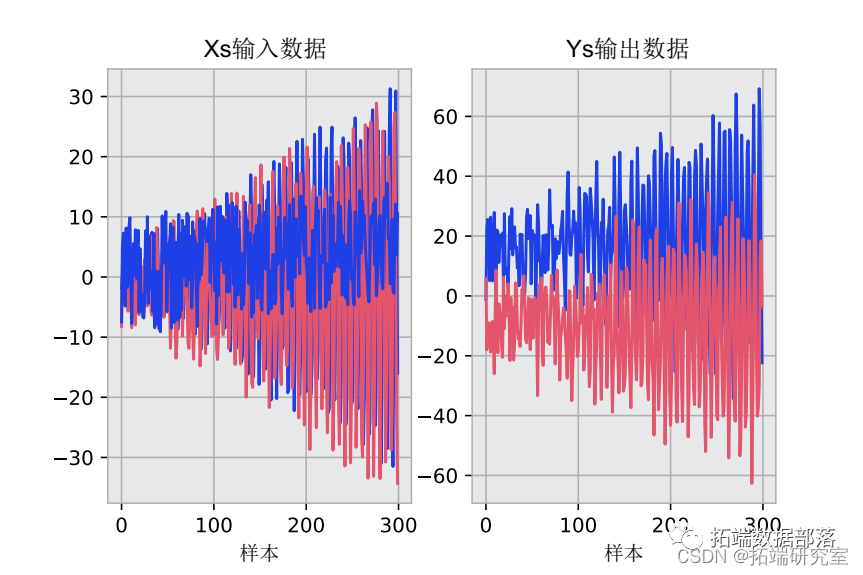

Python进行多输出(多因变量)回归:集成学习梯度提升决策树GRADIENT BOOSTING,GBR回归训练和预测可视化

在之前的文章中,我们研究了许多使用 多输出回归分析的方法。在本教程中,我们将学习如何使用梯度提升决策树GRADIENT BOOSTING REGRESSOR拟合和预测多输出回归数据。对于给定的 x 输入数据,多输出数据包含多个目标标签。本教程涵盖: 准备数据 定义模型 预测和可视化结果 我们将从加载本教程所需的库开始。 ...

集成学习之随机森林、Adaboost、Gradient Boosting、XGBoost原理及使用

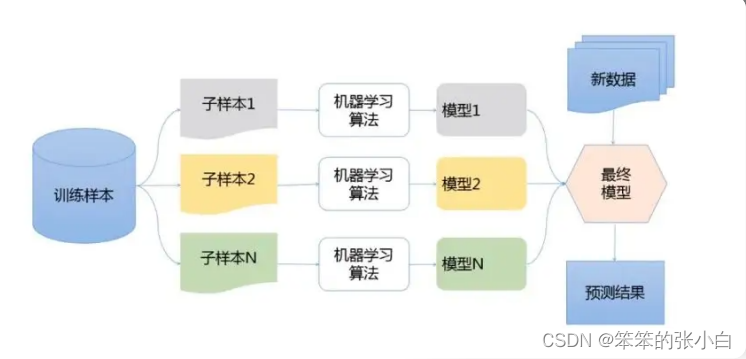

集成学习 什么是集成学习集成学习(ensemble learning)本身不是一个单独的机器学习算 法,而是通过构建并结 合多个机器学习模型来完成学习任务——博采众长。集成学习很好 的避免了单一学习模型带 来的过拟合问题。 集成学习的类型根据个体学习器的生成方式,目前的集成学习方法大致可分为两 大类:Bagging(个体学习器间不存在强依赖关系、可同时生成的并行化 方法)Boosting(个体学....

集成学习之Boosting —— Gradient Boosting实现

Gradient Boosting的一般算法流程 初始化: \(f_0(x) = \mathop{\arg\min}\limits_\gamma \sum\limits_{i=1}^N L(y_i, \gamma)\) for m=1 to M: (a) 计算负梯度: $\tilde{y}_i = -\frac{\partial L(y_i,f_{m-1}(x_i))}{\partial ...

集成学习之Boosting —— Gradient Boosting原理

集成学习之Boosting —— AdaBoost原理 集成学习之Boosting —— AdaBoost实现 集成学习之Boosting —— Gradient Boosting原理 集成学习之Boosting —— Gradient Boosting实现 上一篇介绍了AdaBoost算法,AdaBoost每一轮基学习器训练过后都会更新样本权重,再训练下一个学习器,最后将所有的基学习器加权组.....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

集成学习相关内容

- 集成学习性能

- 学习集成swagger

- 学习集成

- 机器学习集成学习

- 模型集成学习

- 集成学习stacking

- 集成学习随机森林

- 集成学习梯度

- 集成学习机器学习

- 集成学习learning

- 集成学习分类

- 机器学习集成学习模型

- 分类集成学习

- 集成学习bagging boosting

- 机器学习集成学习boosting

- 集成学习boosting

- 集成学习原理

- 集成学习树

- 集成学习梯度树

- 集成学习决策树

- 集成学习gradient boosting

- scikit-learn集成学习

- 教程集成迁移学习

- 教程集成学习

- 集成迁移学习

- xgboost集成学习

- 集成学习模型

- 学习集成gitlab

- 集成学习task1

- 集成学习机器学习模型