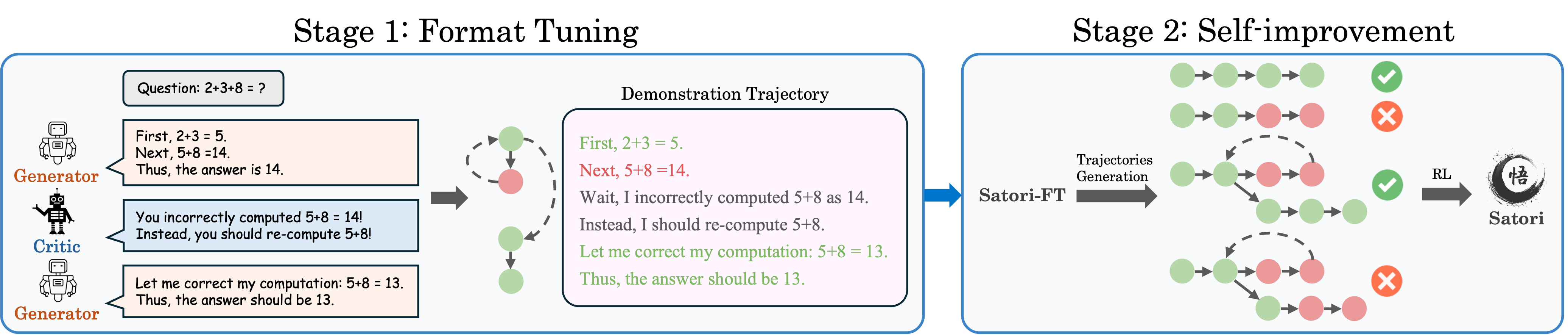

仅7B的模型数学推理能力完虐70B?MIT哈佛推出行动思维链COAT让LLM实现自我反思并探索新策略

❤️ 如果你也关注 AI 的发展现状,且对 AI 应用开发感兴趣,我会每日分享大模型与 AI 领域的开源项目和应用,提供运行实例和实用教程,帮助你快速上手AI技术! 微信公众号|搜一搜:蚝油菜花 大家好,我是蚝油菜花,在海量模型中某一个不起眼的角落,竟有这么一个数学推理专家,它仅靠 7B 的参数量,却足以超越一众主流的小型模型,并与大型模型不相上下。究竟是怎么做到的呢? 今天跟大家分享一下...

在ACK Edge集群中部署混合云LLM弹性推理

为解决混合云场景下部署LLM推理业务时,流量的不均衡带来的数据中心GPU资源分配问题,ACK Edge集群提供了一套混合云LLM弹性推理解决方案,帮您统一管理云上和云下的GPU资源,低峰期优先使用云下数据中心资源,高峰期资源不足时快速启用云上资源。该方案帮您显著降低LLM推理服务运营成本,动态调整并灵活利用资源,保障服务稳定性,避免资源闲置。

加速大语言模型推理:NVIDIATensorRT-LLM更新

加速大语言模型推理:NVIDIATensorRT-LLM更新 内容介绍 一、大模型推理挑战与解决方案 二、大模型推理优化与性能提升策略 三、KVCash在用户请求处理中的应用 四、大模型优化与应用探索 本次分享的主题是加速大语言模型推理:NVIDIATensorRT-LLM更新,由NVIDIA开发与技术部门亚太区资深...

使用DeepGPU-LLM镜像构建模型的推理环境

在GPU实例上配置DeepGPU-LLM容器镜像后,可以帮助您快速构建大语言模型(例如Llama模型、ChatGLM模型、百川Baichuan模型或通义千问Qwen模型)的推理环境,主要应用在智能对话系统、文本分析、编程辅助等自然语言处理业务场景,您无需深入了解底层的硬件优化细节,镜像拉取完成后,无需额外配置即可开箱即用。本文为您介绍如何在GPU实例上使用DeepGPU-LLM容器镜像构建大语言模...

使用TensorRT-LLM构建模型的推理环境

在GPU的实例上安装推理引擎TensorRT-LLM,可以帮助您快速且方便地构建大语言模型(例如Llama模型、ChatGLM模型、百川Baichuan模型或通义千问Qwen模型)的推理环境,主要应用在智能对话系统、文本分析等自然语言处理业务场景。本文为您介绍如何在GPU实例上安装和使用TensorRT-LLM来快速构建大语言模型的高性能推理优化功能。

Ascend推理组件MindIE LLM

MindIE LLM是MindIE解决方案下的大语言模型推理组件,基于昇腾硬件提供业界通用大模型推理能力,同时提供多并发请求的调度功能,支持Continuous Batching、PageAttention、FlashDecoding等加速特性,使能用户高性能推理需求。 MindIE LLM主要提供大模型推理Python API和大模型调度...

使用LLM智能路由提升推理效率

在大语言模型(LLM)应用场景中,存在资源需求不确定性、后端推理实例负载不均衡等问题。为了优化这类问题,EAS引入了LLM智能路由基础组件。在请求调度层,基于LLM场景所特有的Metrics(指标),来动态进行请求分发,保证后端推理实例处理的算力和显存尽可能均匀,提升集群资源使用水位。

苹果一篇论文得罪大模型圈?Transformer不会推理,只是高级模式匹配器!所有LLM都判死刑

近日,苹果公司发表了一篇名为《GSM-Symbolic: Understanding the Limitations of Mathematical Reasoning in Large Language Models》的论文,该论文对大型语言模型(LLM)在数学推理方面的能力提出了质疑。这篇论文的发布,在人工智能领域尤其是大...

容器服务 ACK 大模型推理最佳实践系列一:TensorRT-LLM

【阅读原文】戳:容器服务 ACK 大模型推理最佳实践系列一:TensorRT-LLM 在ACK中使用KServe部署Triton+TensorRT-LLM。本教程以Llama-2-7b-hf模型为例,演示如何在ACK中使用KServe部署Triton框架。Triton采用TensorRT-LLM后端。 背景介绍 &nb...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。