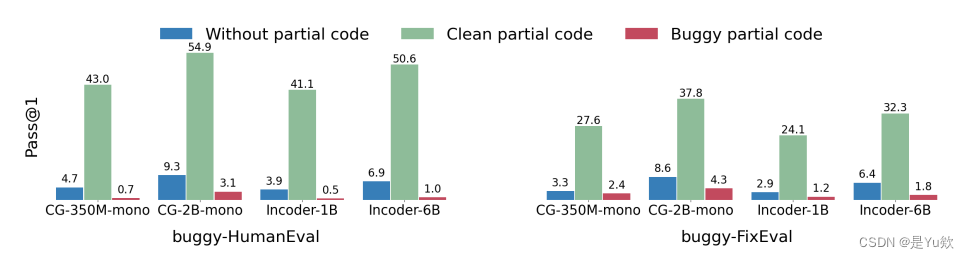

24 LLM错误代码补全:机器学习顶会NeurIPS‘23 智能体评估:自行构建数据集Buggy-HumanEval、Buggy-FixEval+错误代码补全+修复模型【网安AIGC专题11.22】

写在最前面本文为邹德清教授的《网络安全专题》课堂笔记系列的文章,本次专题主题为大模型。一位同学分享了Large Language Models of Code Fail at Completing Code with Potential Bugs《大语言模型在具有潜在错误代码补全中的问题》论文发表在NeurIPS’23,机器学习三大顶会之一。分享时的PPT简洁大方后来重读论文时,发现汇报时的中文....

23REPEAT方法:软工顶会ICSE ‘23 大模型在代码智能领域持续学习 代表性样本重放(选择信息丰富且多样化的示例) + 基于可塑权重巩固EWC的自适应参数正则化 【网安AIGC专题11.22】

写在最前面本文为邹德清教授的《网络安全专题》课堂笔记系列的文章,本次专题主题为大模型。黄邕灵同学@potato&&tomato:分享了Keeping Pace with Ever-Increasing Data:Towards Continual Learning of Code Intelligence Models《跟上不断增长的数据:迈向代码智能模型的持续学习》软工顶会IC....

19ContraBERT:顶会ICSE23 数据增强+对比学习+代码预训练模型,提升NLP模型性能与鲁棒性:处理程序变异(变量重命名)【网安AIGC专题11.15】

写在最前面随着大规模代码的崛起,无监督学习成为了提高代码预训练模型性能的有效手段。这些预训练模型在广泛的下游任务中表现出色,如自然语言处理和程序语言处理。例如,像CodeBERT和GraphCodeBERT这样的模型在预训练阶段通过大规模代码数据学到通用的表示,并在下游任务上进行微调,取得了优于传统监督学习方法的成绩。然而,这些模型在面对代码变异等挑战时,鲁棒性仍然有待提高。该论文关注的问题是:....

16CODEIPPROMPT:顶会ICML’23 从GitHub到AI,探索代码生成的侵权风险与缓解策略的最新进展:训练数据`有限制性许可;模型微调+动态Token过滤【网安AIGC专题11.8】

写在最前面在人工智能和自然语言处理迅速发展的领域中,代码语言模型已成为技术互动的基石。它们能够基于提示生成代码,从而彻底改变了我们与技术的互动方式。然而,这一进步带来了一个关键问题:知识产权侵犯。在本篇博客中,我们将深入探讨在ICML '23上展示的一项开创性研究,探索大型语言模型在代码生成中侵犯知识产权的程度。本文为邹德清教授的《网络安全专题》课堂笔记系列的文章,本次专题主题为大模型。姬煜同学....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。